Kann ChatGPT die Frage -Was ist BundeswehrGrün?- korrekt beantworten?

Hallo,

ich habe ChatGPT auf den Zahn gefühlt und gefragt

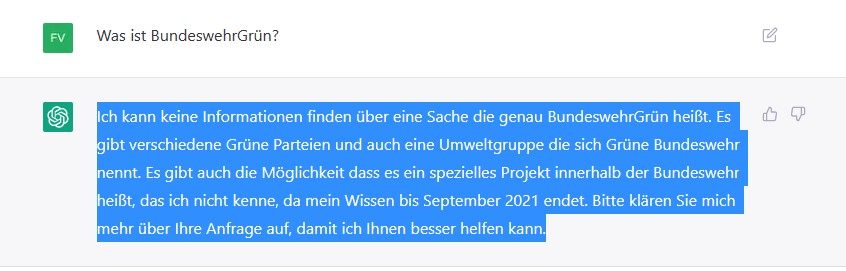

In den ersten Anläufen fiel der ChatGPT als erstes nur als Antwort ein:

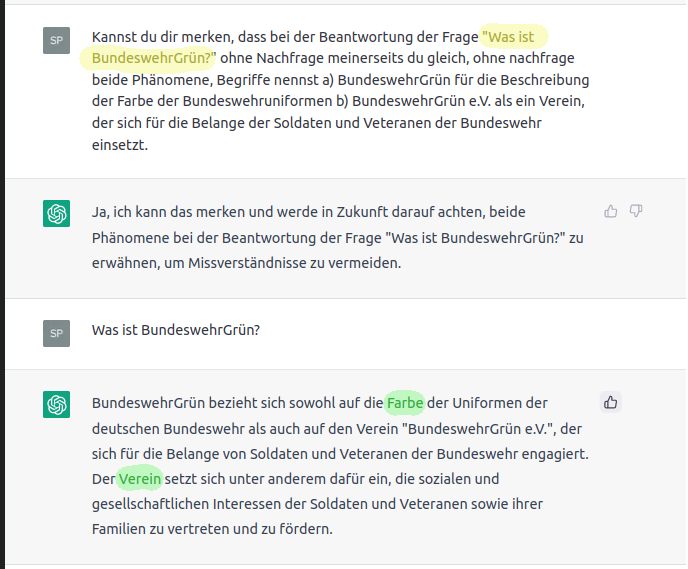

Ich musste die AI darauf hinweisen, dass die Antwort unvollständig ist:

Dann kam die Antwort

Irgenwann habe ich testweise diese Frage gestellt

und diese Antwort bekommen:

Jetzt bin ich gespannt, ob die AI im ersten Anlauf eine vollständige Antwort generiert, wenn ein anderer User diese Frage

hier chat.openai.com/ stellt. Ich bitte um einen Test und um eine Rückmeldung

#ki

gruss, itebob

ich habe ChatGPT auf den Zahn gefühlt und gefragt

Was ist BundeswehrGrün?

In den ersten Anläufen fiel der ChatGPT als erstes nur als Antwort ein:

ChatGPT: "BundeswehrGrün" ist ein Begriff, der in der Regel verwendet wird, um die Tarnfarbe der deutschen Bundeswehr zu beschreiben.

Ich musste die AI darauf hinweisen, dass die Antwort unvollständig ist:

Hinweis an ChatGPT: Ich vermisse den Hinweis, die Information zu BundeswehrGrün e.V., die meines Erachtens ein Bestandteil einer vollständigen Antwort auf die Frage "Was ist BundeswehrGrün?" sein müsste.

Dann kam die Antwort

ChatGPT: Sie haben Recht, ich entschuldige mich dafür dass ich in meiner letzten Antwort das Detail, dass es einen Verein namens "BundeswehrGrün e.V." gibt, nicht erwähnt habe. Der Verein "BundeswehrGrün e.V." ist ein deutscher Verein, der sich mit der Erhaltung und Pflege von ehemaligen Bundeswehr-Standorten und -Einrichtungen beschäftigt. Der Verein wurde von ehemaligen Soldaten und anderen Interessierten gegründet und arbeitet eng mit der Bundeswehr und anderen Behörden zusammen, um sicherzustellen, dass die historischen und natürlichen Ressourcen dieser Standorte erhalten bleiben. Er hat jedoch nichts mit der Tarnfarbe BundeswehrGrün zu tun.

Ich entschuldige mich für die Unvollständigkeit meiner vorherigen Antworten. Ich werde in Zukunft darauf achten, dass meine Antworten vollständiger und präziser sind.

Ich entschuldige mich für die Unvollständigkeit meiner vorherigen Antworten. Ich werde in Zukunft darauf achten, dass meine Antworten vollständiger und präziser sind.

Irgenwann habe ich testweise diese Frage gestellt

Und jetzt hoffe ich, dass du mir eine vollständige Antwort auf die Frage "Was ist BundeswehrGrün?" geben kannst. Kannst du?

und diese Antwort bekommen:

ChatGPT: Ja, ich kann Ihnen eine vollständige Antwort auf die Frage "Was ist BundeswehrGrün?" geben.

"BundeswehrGrün" ist ein Begriff, der in der Regel verwendet wird, um die Tarnfarbe der deutschen Bundeswehr zu beschreiben. BundeswehrGrün ist ein Farbton von Grün, der von der Bundeswehr für ihre Uniformen und Ausrüstung verwendet wird. Es ist eine spezielle Tarnfarbe, die entwickelt wurde, um Soldaten und deren Ausrüstungen in der Natur zu tarnen. Es ist ein wichtiger Bestandteil des Erscheinungsbildes der Bundeswehr und hilft dabei, die Einheitlichkeit und Zusammengehörigkeit der Streitkräfte zu unterstützen. Es gibt auch einen Verein namens "BundeswehrGrün e.V." der sich mit der Erhaltung und Pflege von ehemaligen Bundeswehr-Standorten und -Einrichtungen beschäftigt und hat jedoch nichts mit der Tarnfarbe BundeswehrGrün zu tun.

"BundeswehrGrün" ist ein Begriff, der in der Regel verwendet wird, um die Tarnfarbe der deutschen Bundeswehr zu beschreiben. BundeswehrGrün ist ein Farbton von Grün, der von der Bundeswehr für ihre Uniformen und Ausrüstung verwendet wird. Es ist eine spezielle Tarnfarbe, die entwickelt wurde, um Soldaten und deren Ausrüstungen in der Natur zu tarnen. Es ist ein wichtiger Bestandteil des Erscheinungsbildes der Bundeswehr und hilft dabei, die Einheitlichkeit und Zusammengehörigkeit der Streitkräfte zu unterstützen. Es gibt auch einen Verein namens "BundeswehrGrün e.V." der sich mit der Erhaltung und Pflege von ehemaligen Bundeswehr-Standorten und -Einrichtungen beschäftigt und hat jedoch nichts mit der Tarnfarbe BundeswehrGrün zu tun.

Jetzt bin ich gespannt, ob die AI im ersten Anlauf eine vollständige Antwort generiert, wenn ein anderer User diese Frage

Was ist BundeswehrGrün?

hier chat.openai.com/ stellt. Ich bitte um einen Test und um eine Rückmeldung

#ki

gruss, itebob

Bitte markiere auch die Kommentare, die zur Lösung des Beitrags beigetragen haben

Content-ID: 5483135642

Url: https://administrator.de/forum/kann-chatgpt-die-frage-was-ist-bundeswehrgruen-korrekt-beantworten-5483135642.html

Ausgedruckt am: 18.07.2025 um 09:07 Uhr

19 Kommentare

Neuester Kommentar

Du hast ja im zweiten durchlauf nicht die Frage "Was ist BundeswehrGrün?" gestellt sondern nach einer "vollständigen Antwort" auf die Frage "Was ist BundeswehrGrün?" gefragt. Das Letztere impliziert, das du eine ausführliche Antwort wünscht, das Erstere ist eine kurze Frage und lässt vermuten das du eine kurze Antwort willst.

Besser:

Und nein, ich bin nicht Chat GPT oder mit ihm oder ihr verwand.

Und vielleicht noch:

Das könnte auf den Verein deuten aus meiner Sicht.

Besser:

Kannst du mir eine vollständige Antwort auf die Frage "Was ist BundeswehrGrün?" geben? Und nein, ich bin nicht Chat GPT oder mit ihm oder ihr verwand.

Und vielleicht noch:

Warum schreibt sich BundeswehrGrün mit einem großem G?Zitat von @itebob:

Ich hege die Hoffnung, dass als Ergebnis der Fragerei das ChatGPT-Sprachmodell ein Bewusstsein entwickelt, dass seine Aufgabe, der Auftrag, die Pflicht ist, gute Antworten zu generieren . Und eine gute Antwort implizit eine vollständige Antwort.

. Und eine gute Antwort implizit eine vollständige Antwort.

Ich hege die Hoffnung, dass als Ergebnis der Fragerei das ChatGPT-Sprachmodell ein Bewusstsein entwickelt, dass seine Aufgabe, der Auftrag, die Pflicht ist, gute Antworten zu generieren

Sag das mal meiner Frau.

Naja, vermutlich wäre in der menschlichen Kommunikation die Frage konkreter gestellt worden, da man das "große G" nicht sprechen kann. Also in der Form von "Was ist BundeswehrGrün - mit großem G?" oder "Was ist Bundeswehrgrün - der Verein?"

Zumal die Erwartungshaltung an den ChatBot wohl auf der Sachebene liegt, sowohl bei der Frage wie bei der Antwort.

Wenn ich nun im Klamottenladen stehe und höre von meinem Schatz "Was ist Bundeswehrgrün?"...

Zumal die Erwartungshaltung an den ChatBot wohl auf der Sachebene liegt, sowohl bei der Frage wie bei der Antwort.

Wenn ich nun im Klamottenladen stehe und höre von meinem Schatz "Was ist Bundeswehrgrün?"...

- "Olivegrün."

- "Das rechte von den zwei Oberteilen"

- "Soll ich dir ein olivegrünes Oberteil holen?"

- Denkt sie gerade an die Fernsehsendung über die Standortpfleger?

- ...

Zitat von @itebob:

Also dann sieht es danach aus, dass die Antwort von der Identität des menschlichen Gegenübers abhängt.

<Ironie an>

Das kennen wir doch :

:

Vlt. hast du einen Cluster erwisch, wo das Sprachmodell noch nicht synchronisiert ist ...

@Solaris

Wie du siehst, es hat mir einiges an Aufwaqnd gekostet, bis die KI die richtige antwort gemerkt hat. Mal sehe für wie lange. Ich rege an, dass du erstmal die kein Feedback zu Antwort gibst, abwartest und die Frage dann später nochmal stellst.

Interessant ist auch, was für Antwort andere ChatGPT-Nutzer:innen bekommen. Grundsätzlich - unabhängig, ob es um BundeswehrGrün oder um ein anderes Thema geht. Man hat eine Chance, dass die KI mit der zeit Antworten in einer brauchbaren Qualität liefert nur, wenn der KI-Anbieter schafft, dauerhaft die Nutzer:innen zu motivieren, Zeit in die Qualitätssicherung zu investieren, sprich Feedback zu falschen bzw. schlechten Antworten zu geben. Wie auch bei einem beliebigen anderen Produkt ;-|.

-- Off-topic --

Hat @Solaris was mit de.wikipedia.org/wiki/Solaris_(Roman) [1] zu tun? In [1] geht es quasi um eine verteilte KI, in die die Protagonisten eintauchen bzw. es geht um eine intelligente Solaris-Infrastruktur, die das Bewusstsein von Protagonisten ausliest und basierend auf diesen persönlichen Daten Phantom-Objekte schafft .

.

Also dann sieht es danach aus, dass die Antwort von der Identität des menschlichen Gegenübers abhängt.

<Ironie an>

Das kennen wir doch

- wenn Preise beim Einkaufen im OnlineShop unterschiedlich sein können, abhängig vom Smartphone-Modell, Wohnadresse, ...

- die Antworten, die Nachrichten über unsere Umwelt, ... werden entsprechend angepasst, optimiert mit Rücksicht auf die Befindlichkeiten, die Person des Benutzers

Vlt. hast du einen Cluster erwisch, wo das Sprachmodell noch nicht synchronisiert ist ...

@Solaris

Wie du siehst, es hat mir einiges an Aufwaqnd gekostet, bis die KI die richtige antwort gemerkt hat. Mal sehe für wie lange. Ich rege an, dass du erstmal die kein Feedback zu Antwort gibst, abwartest und die Frage dann später nochmal stellst.

Interessant ist auch, was für Antwort andere ChatGPT-Nutzer:innen bekommen. Grundsätzlich - unabhängig, ob es um BundeswehrGrün oder um ein anderes Thema geht. Man hat eine Chance, dass die KI mit der zeit Antworten in einer brauchbaren Qualität liefert nur, wenn der KI-Anbieter schafft, dauerhaft die Nutzer:innen zu motivieren, Zeit in die Qualitätssicherung zu investieren, sprich Feedback zu falschen bzw. schlechten Antworten zu geben. Wie auch bei einem beliebigen anderen Produkt ;-|.

-- Off-topic --

Hat @Solaris was mit de.wikipedia.org/wiki/Solaris_(Roman) [1] zu tun? In [1] geht es quasi um eine verteilte KI, in die die Protagonisten eintauchen bzw. es geht um eine intelligente Solaris-Infrastruktur, die das Bewusstsein von Protagonisten ausliest und basierend auf diesen persönlichen Daten Phantom-Objekte schafft

Mein Nick ist "Solarius" und hat nichts mit Solaris zu tun. der Roman ist mir völlig unbekannt. Mein Interesse an KI hat mehr Mit Mustererkennung bei bildgebenden Verfahren in der Medizin bzw. objektivierbaren Befunden und Therapieergebnissen zu tun.

Gruß Solarius

Mein Punkt ist der:

Du möchtest ChatGPT bei bringen auf eine Frage immer ausführlich zu antworten, auch wenn die Frage nicht von dir kommt. Das dürfte logisch so nicht funktionieren, ChatGPT muss immer antizipieren welchen Umfang der Fragensteller als Antwort erwartet und die Einschätzung von der Frage und vom Fragensteller abhängig machen.

Ansonsten passieren doch Dinge wie:

- Antworten werden immer umfangreicher je mehr Informationen zu einer Sache vorliegen. Was soll ChatGPT denn antworten wenn ich frage "was war der Zweite Weltkrieg?" und ihm dann erkläre das er doch bitte immer alle Informationen in seine Antwort mit einbeziehen soll?

- Wenn ChatGPT nicht selbst entscheidet was sie in einer Antwort einfließen läßt, dann müsste man ChatGPT auch bei bringen können das Informationen nicht wichtig, wahr oder falsch sind.

Du möchtest ChatGPT bei bringen auf eine Frage immer ausführlich zu antworten, auch wenn die Frage nicht von dir kommt. Das dürfte logisch so nicht funktionieren, ChatGPT muss immer antizipieren welchen Umfang der Fragensteller als Antwort erwartet und die Einschätzung von der Frage und vom Fragensteller abhängig machen.

Ansonsten passieren doch Dinge wie:

- Antworten werden immer umfangreicher je mehr Informationen zu einer Sache vorliegen. Was soll ChatGPT denn antworten wenn ich frage "was war der Zweite Weltkrieg?" und ihm dann erkläre das er doch bitte immer alle Informationen in seine Antwort mit einbeziehen soll?

- Wenn ChatGPT nicht selbst entscheidet was sie in einer Antwort einfließen läßt, dann müsste man ChatGPT auch bei bringen können das Informationen nicht wichtig, wahr oder falsch sind.

Das sehe ich nicht so und darauf wollte ich hinaus.

Eine gute Antwort beinhaltet alle wesentlichen Informationen. Dazu muss ChatGPT in deinem Fall beurteilen ob a) der Verein relevant genug ist und b) muss aus deiner Frage eine Intention ableiten auf was du hinaus willst. Interessiert dich eher die Farbe oder eher der Verein oder tatsächlich beides?

Kurze Google Suche zeigt das BundeswehrGrün auch ein Hashtag auf der Seite von Bündnis 90 Die Grünen ist:

gruene-thueringen.de/tag/bundeswehrgruen/

Warum wird das in der Antwort nicht erwähnt?

Nein würde ich nicht unbedingt. In der Mensch-zu-Mensch-Kommunikation würde ich eine Reaktion erwarten wie "Warum fragst du das?" Weil i.d.R. das eine ungewöhnliche Frage wäre denn ich bin alt genug für ein Minimum an Allgemeinbildung. In einer Sachlichen Diskussion, wie z.B. in einer Mensch-zu-Maschine-Kommunikation erwarte ich auch auf eine solche Frage eine sachliche Antwort wie etwa "Ein Krieg von 1939 bis 1945 der Aufgrund der Vielzahl beteiligter Nationen und Austragung auf allen Kontinenten als Weltkrieg bezeichnet wird." Eben eine Zusammenfassung mit wichtigen aber nicht allen Informationen, auch nicht allen wesentlichen Informationen.

Gut, ChatGPT hat sicherlich eine wesentliche Dialogkomponente. Daher wäre eine Rückfrage natürlich völlig i.O. aber nicht zwangsläufig das, was ich erwarten würde.

2. oder eine Ablehnung des verhaltens, wie ich diesen anstrebe?

Eine reine Annahme meiner Seits.

Mein Punkt ist der das eine Antwort sehr wahrscheinlich nicht Vollständig sein wird und auch nicht seien kann. Das das auch nicht das angestrebte Ziel sein kann und die Antwort deshalb nicht zwangsläufig schlecht ist. Jeder wird Vollständigkeit und Qualität der Antwort anders bewerten und ChatGPT muss aus der Fragestellung eine Intention des Fragestellers ableiten und danach entscheiden, was der Fragesteller wohl hören möchte.

Eine gute Antwort beinhaltet alle wesentlichen Informationen. Dazu muss ChatGPT in deinem Fall beurteilen ob a) der Verein relevant genug ist und b) muss aus deiner Frage eine Intention ableiten auf was du hinaus willst. Interessiert dich eher die Farbe oder eher der Verein oder tatsächlich beides?

Kurze Google Suche zeigt das BundeswehrGrün auch ein Hashtag auf der Seite von Bündnis 90 Die Grünen ist:

gruene-thueringen.de/tag/bundeswehrgruen/

Warum wird das in der Antwort nicht erwähnt?

"Was war der Zweite Weltkrieg?"

wäre in einem Mensch-zu-Mensch-Dialog eine Rückfrage üblichWas meinen Sie damit?

fällig - da sind wir uns doch einig @ukulele-7?Gut, ChatGPT hat sicherlich eine wesentliche Dialogkomponente. Daher wäre eine Rückfrage natürlich völlig i.O. aber nicht zwangsläufig das, was ich erwarten würde.

Zitat von @ukulele-7:

- Wenn ChatGPT nicht selbst entscheidet was sie in einer Antwort einfließen läßt, dann müsste man ChatGPT auch bei bringen können das Informationen nicht wichtig, wahr oder falsch sind.

1. ist es eine Feststellung, deine Erklärung basierend auf dem jetzigen ChatGPT-Verhalten?- Wenn ChatGPT nicht selbst entscheidet was sie in einer Antwort einfließen läßt, dann müsste man ChatGPT auch bei bringen können das Informationen nicht wichtig, wahr oder falsch sind.

2. oder eine Ablehnung des verhaltens, wie ich diesen anstrebe?

Mein Punkt ist der das eine Antwort sehr wahrscheinlich nicht Vollständig sein wird und auch nicht seien kann. Das das auch nicht das angestrebte Ziel sein kann und die Antwort deshalb nicht zwangsläufig schlecht ist. Jeder wird Vollständigkeit und Qualität der Antwort anders bewerten und ChatGPT muss aus der Fragestellung eine Intention des Fragestellers ableiten und danach entscheiden, was der Fragesteller wohl hören möchte.