Setzt ihr Chat GPT oder ähnliche Tools in eurem Admin-Alltag ein?

Moin zusammen,

mich würde mal interessieren, wie ihr aktuell mit Chat GPT & Co. in eurem IT-Alltag umgeht.

Ich arbeite selbst als Admin in einer mittelgroßen Umgebung (hauptsächlich Windows, etwas Linux, viel AD, Office 365 etc.), und ehrlich gesagt habe ich Chat GPT mittlerweile ziemlich häufig im Einsatz. Zum Beispiel:

Beim schnellen Schreiben von PowerShell-Skripten oder um sich an selten genutzte Befehle zu erinnern

Beim Erklären von Registry-Einträgen, die ich so auf die Schnelle nicht einordnen konnte

Oder auch mal zum Formulieren von Mails an Benutzer (die höflich sein sollen, auch wenn man gerade zum dritten Mal dieselbe Frage beantwortet 😅)

Natürlich verlasse ich mich nicht blind drauf, aber oft spart es einfach Zeit. Ich sehe es als eine Art "Junior Admin", der immer verfügbar ist.

Jetzt frage ich mich:

Wie ist das bei euch? Nutzt ihr solche Tools? Habt ihr sie sogar offiziell im Team/Unternehmen eingeführt – oder ist das bei euch ein No-Go wegen Datenschutz, Compliance etc.?

Mich interessieren vor allem auch die kritischen Stimmen:

Wo sind euch klare Grenzen aufgefallen?

Habt ihr schon mal "Halluzinationen" erlebt, die euch fast in die Irre geführt hätten?

Oder sagt ihr vielleicht: "So ein Quatsch, ein echter Admin braucht sowas nicht!"?

Freue mich auf den Austausch – gern ehrlich und praxisnah.

Grüße

_Charles R.Howard_

mich würde mal interessieren, wie ihr aktuell mit Chat GPT & Co. in eurem IT-Alltag umgeht.

Ich arbeite selbst als Admin in einer mittelgroßen Umgebung (hauptsächlich Windows, etwas Linux, viel AD, Office 365 etc.), und ehrlich gesagt habe ich Chat GPT mittlerweile ziemlich häufig im Einsatz. Zum Beispiel:

Beim schnellen Schreiben von PowerShell-Skripten oder um sich an selten genutzte Befehle zu erinnern

Beim Erklären von Registry-Einträgen, die ich so auf die Schnelle nicht einordnen konnte

Oder auch mal zum Formulieren von Mails an Benutzer (die höflich sein sollen, auch wenn man gerade zum dritten Mal dieselbe Frage beantwortet 😅)

Natürlich verlasse ich mich nicht blind drauf, aber oft spart es einfach Zeit. Ich sehe es als eine Art "Junior Admin", der immer verfügbar ist.

Jetzt frage ich mich:

Wie ist das bei euch? Nutzt ihr solche Tools? Habt ihr sie sogar offiziell im Team/Unternehmen eingeführt – oder ist das bei euch ein No-Go wegen Datenschutz, Compliance etc.?

Mich interessieren vor allem auch die kritischen Stimmen:

Wo sind euch klare Grenzen aufgefallen?

Habt ihr schon mal "Halluzinationen" erlebt, die euch fast in die Irre geführt hätten?

Oder sagt ihr vielleicht: "So ein Quatsch, ein echter Admin braucht sowas nicht!"?

Freue mich auf den Austausch – gern ehrlich und praxisnah.

Grüße

_Charles R.Howard_

Bitte markiere auch die Kommentare, die zur Lösung des Beitrags beigetragen haben

Content-ID: 673413

Url: https://administrator.de/forum/chat-gpt-admin-tools-673413.html

Ausgedruckt am: 28.07.2025 um 16:07 Uhr

115 Kommentare

Neuester Kommentar

Ist für mich, als KU-Supporter (der überall ein bisschen können muss) ein sehr wichtiger "Kollege" geworden. Fast wie ein Mensch. (Schon nur) der Austausch ist oft hilfreich, manchmal ist er faul, dann muss man ihm in den Hintern treten. Manchmal weiß er was nicht, aber das ist im RL ja auch nicht anders - und es gibt einem ein gutes Gefühl, auch mal was besser zu wissen

Extrem hilfreich bei administrativen Skripten. Selbst wenn ich sie selbst schreibe, ist das beim Debugging eine große Hilfe.

Toll auch zu lernen. Erklärt Dinge gut, auch wenn man 5x nachfragt.

Auch sehr zu schätzen ist der stets sachbezogene und freundliche Duktus, der unseren RL-Kollegen ja nicht immer gelingt

Insgesamt versuche ich aber stets, das Problem selbst zu durchdringen, einen Lösungsansatz zu finden und nur die Spezifika nachzufragen. Wäre, glaube ich, nicht so gut, sich das Denken komplett abzugewöhnen und ich bin sicher, wem es an Basiswissen mangelt, der hat schon bei der Fragestellung, spätestens aber bei der Interpretation des Ergebnisses verloren.

Warum ich "ihn" als Mann interpretiere, weiß ich selbst nicht. Soll keine Ungerechtigkeit sein. Wahrscheinlich stimmt "es" sich auf meine Herangehensweise ab.

Viele Grüße, commodity

Moin,

ich nutze die KI auch immer häufiger, aber nicht um mir Themen erklären zu lassen, sondern um sehr spezifische Fragen zu klären, ohne mich zeitintensiv selbst damit zu beschäftigen. Ich nutze perplexity, ich finde es gut, dass auch immer die Quellen mit angegeben werden für bestimmte Aussagen, die lese ich dann auch selbst durch. Für das Erstellen von Scripts ist es wirklich sehr nützlich, ich prüfe die aber auch immer (zumindest mit meinen rudimentären Scriptverständnis).

Habe perplexity vor kurzem gebeten, mir ein Script zu schreiben, dass auf einem Terminalserver bei allen Usern die jeweiligen TEMP-Verzeichnisse löschen soll. Hat wunderbar funktioniert und hilft sehr.

Mails usw verfasse ich aber stets selber, denn das KI Geblabber ertrage ich selbst nicht. Mir stößt aber auch unangenehm auf, dass unsere Azubis gefühlt 100% von der KI abhängig sind und alles glauben. Ich weiß noch nicht, wie wir damit umgehen sollten, schwieriges Thema...

MfG

ich nutze die KI auch immer häufiger, aber nicht um mir Themen erklären zu lassen, sondern um sehr spezifische Fragen zu klären, ohne mich zeitintensiv selbst damit zu beschäftigen. Ich nutze perplexity, ich finde es gut, dass auch immer die Quellen mit angegeben werden für bestimmte Aussagen, die lese ich dann auch selbst durch. Für das Erstellen von Scripts ist es wirklich sehr nützlich, ich prüfe die aber auch immer (zumindest mit meinen rudimentären Scriptverständnis).

Habe perplexity vor kurzem gebeten, mir ein Script zu schreiben, dass auf einem Terminalserver bei allen Usern die jeweiligen TEMP-Verzeichnisse löschen soll. Hat wunderbar funktioniert und hilft sehr.

Mails usw verfasse ich aber stets selber, denn das KI Geblabber ertrage ich selbst nicht. Mir stößt aber auch unangenehm auf, dass unsere Azubis gefühlt 100% von der KI abhängig sind und alles glauben. Ich weiß noch nicht, wie wir damit umgehen sollten, schwieriges Thema...

MfG

Moin.

Ich sehe ein großes Problem darin, dass sich KI scheuen, Unsicherheiten bei der Antwort anzugeben - die KI sagt nie "ich bin mir lediglich recht sicher, dass...".

Ich habe schon dutzende Fragestellungen (zur Windowsadministration, zu Skripten, zu Hardwarerecherche) an die KI abgegeben und schätze, dass von den Antworten 3/4 falsch waren. Je komplizierter die Frage war, desto mehr.

Bei einem Skript hat die KI zum Beispiel erst im 15. Anlauf das Problem gelöst obwohl sie jedes Mal zuvor beteuert hatte, nun das Problem erkannt zu haben. Und da auch erst, nachdem ich der KI einen Link zu einer Site mit einem Skript zu einer ähnlichen Aufgabe übergeben habe.

Halluzinationen? Ständig, meistens.

Ich sehe ein großes Problem darin, dass sich KI scheuen, Unsicherheiten bei der Antwort anzugeben - die KI sagt nie "ich bin mir lediglich recht sicher, dass...".

Ich habe schon dutzende Fragestellungen (zur Windowsadministration, zu Skripten, zu Hardwarerecherche) an die KI abgegeben und schätze, dass von den Antworten 3/4 falsch waren. Je komplizierter die Frage war, desto mehr.

Bei einem Skript hat die KI zum Beispiel erst im 15. Anlauf das Problem gelöst obwohl sie jedes Mal zuvor beteuert hatte, nun das Problem erkannt zu haben. Und da auch erst, nachdem ich der KI einen Link zu einer Site mit einem Skript zu einer ähnlichen Aufgabe übergeben habe.

Halluzinationen? Ständig, meistens.

Ich nutze KI um meine Meinung an den Mainstream anzupassen, da ich nicht immer die der Herde teile (noch nicht).

heise.de/news/Unerwuenschtes-KI-Experiment-auf-Reddit-Massive-Kr ...

heise.de/news/Unerwuenschtes-KI-Experiment-auf-Reddit-Massive-Kr ...

Andauernd, große Hilfe beim Skripten, um ein Grundgerüst aufzubauen, und je nachdem wie gut man die Prompts schreibt, mit Links zu Dokus etc., sind die Skript auch meist brauchbar. Manuelles Anpassen ist allerdings fast immer nötig.

Bei Themen zu denen man gar keine Ahnung hat hilft es mir oft, sich mittels KI einen Überblick zu verschaffen.

Compliance, Datenschutz ist kein Problem, so lange man die Chats allgemein hält, Skripts konfigurierbar macht, etc.

Halluzinationen zu Code gibt es regelmäßig, bspw. nicht vorhandene PowerShell-Module. Wenn man das weiß, kann man mMn. gut damit umgehen. Insgesamt kann es auf jeden Fall trotzdem deutlich Zeit sparen.

Ich verwende hauptsächlich Cursor (mit variierendem Modell) und ChatGPT

Bei Themen zu denen man gar keine Ahnung hat hilft es mir oft, sich mittels KI einen Überblick zu verschaffen.

Compliance, Datenschutz ist kein Problem, so lange man die Chats allgemein hält, Skripts konfigurierbar macht, etc.

Halluzinationen zu Code gibt es regelmäßig, bspw. nicht vorhandene PowerShell-Module. Wenn man das weiß, kann man mMn. gut damit umgehen. Insgesamt kann es auf jeden Fall trotzdem deutlich Zeit sparen.

Ich verwende hauptsächlich Cursor (mit variierendem Modell) und ChatGPT

Ich bin ein 3rd-level Administrator und KI hat kein Platz in meiner Arbeit.

Die Probleme die ich löse sind zu spezifisch. Skripte schreiben tue ich selten, und wenn ich muss, dann freuhe ich mich richtig wenn ich das selbst machen darf.

Das Selbe mit E-Mails, sich richtig auszudrücken ist eine Fähigkeit die stätig trainiert werden muss.

Selbst englischsprachige Texte verfasse ich lieber selbst um das nicht zu verlernen.

Die Antworten die KI mir und meinen Kollegen liefert sind oft falsch oder passen nicht zum Kontext.

MfG Oldschool-Admin

Nachtrag: KI wurde an Web-Inhalten trainiert, Foren, Blogs, usw.. Viele Foren und Blogs leben von der Werbung und echten Besuchern, KI nimmt diesen Traffic von den Foren weg und die Werbe-Einnahmen versickern. Langfristig drohen diese Informationsquellen zu verschwinden und wir verlieren neu generiertes Wissen.

Die Probleme die ich löse sind zu spezifisch. Skripte schreiben tue ich selten, und wenn ich muss, dann freuhe ich mich richtig wenn ich das selbst machen darf.

Das Selbe mit E-Mails, sich richtig auszudrücken ist eine Fähigkeit die stätig trainiert werden muss.

Selbst englischsprachige Texte verfasse ich lieber selbst um das nicht zu verlernen.

Die Antworten die KI mir und meinen Kollegen liefert sind oft falsch oder passen nicht zum Kontext.

MfG Oldschool-Admin

Nachtrag: KI wurde an Web-Inhalten trainiert, Foren, Blogs, usw.. Viele Foren und Blogs leben von der Werbung und echten Besuchern, KI nimmt diesen Traffic von den Foren weg und die Werbe-Einnahmen versickern. Langfristig drohen diese Informationsquellen zu verschwinden und wir verlieren neu generiertes Wissen.

Zitat von @DerWoWusste:

Moin.

Ich sehe ein großes Problem darin, dass sich KI scheuen, Unsicherheiten bei der Antwort anzugeben - die KI sagt nie "ich bin mir lediglich recht sicher, dass...".

Ich habe schon dutzende Fragestellungen (zur Windowsadministration, zu Skripten, zu Hardwarerecherche) an die KI abgegeben und schätze, dass von den Antworten 3/4 falsch waren. Je komplizierter die Frage war, desto mehr.

Bei einem Skript hat die KI zum Beispiel erst im 15. Anlauf das Problem gelöst obwohl sie jedes Mal zuvor beteuert hatte, nun das Problem erkannt zu haben. Und da auch erst, nachdem ich der KI einen Link zu einer Site mit einem Skript zu einer ähnlichen Aufgabe übergeben habe.

Halluzinationen? Ständig, meistens.

Moin.

Ich sehe ein großes Problem darin, dass sich KI scheuen, Unsicherheiten bei der Antwort anzugeben - die KI sagt nie "ich bin mir lediglich recht sicher, dass...".

Ich habe schon dutzende Fragestellungen (zur Windowsadministration, zu Skripten, zu Hardwarerecherche) an die KI abgegeben und schätze, dass von den Antworten 3/4 falsch waren. Je komplizierter die Frage war, desto mehr.

Bei einem Skript hat die KI zum Beispiel erst im 15. Anlauf das Problem gelöst obwohl sie jedes Mal zuvor beteuert hatte, nun das Problem erkannt zu haben. Und da auch erst, nachdem ich der KI einen Link zu einer Site mit einem Skript zu einer ähnlichen Aufgabe übergeben habe.

Halluzinationen? Ständig, meistens.

Ok - sagst du bei jeder Antwort "ich bin mir nicht ganz sicher", "ich glaube zu 95% das...."? Man sollte nicht vergessen - es steckt kein Mensch dahinter, es ist ein System welches aus einer Menge Daten eben das wahrscheinlichste raussucht. Und genauso wie bei einer menschlichen Antwort gibt es eben idR. eine gewisse Unsicherheit.

Und "erst im 15ten Anlauf gelöst" - nun, vergleichen wir das mal mit einigen Fragestellungen hier die von Menschen beantwortet werden, da sind 15 Anläufe doch gar nicht mal sooo schlecht! Und es ist ja dann eine Frage ob die KI eben lernt (und der nächste mit derselben Fragestellung deine verbesserte Antwort bekommt) oder eben nicht. Dabei sollte man eben nicht vergessen das vermutlich jede halbwegs anspruchsvolle Aufgabe eben nicht nur eine Lösung hat - und ggf. ein sehr ähnliches Problem wie das was du hattest schon 1000 Leute vorher eben mit einer "kleinen" Abweichung hatten und die Lösungen da gepasst haben. Damit hätte dann die KI ja immernoch eben 99.9% korrekt geantwortet...

Ich selbst nutze die zB. gerne mal für Lösungsideen -> bei der ich eben absichtlich nur ein ähnliches Problem formuliere und schaue wie es gelöst wurde. Damit habe ich dann eben auch kein Problem mit Datenschutz - wenn ich sage ich möchte ein Programm haben welches mir mit Zeitverzögerung ein Lauflicht baut was hin und her läuft wäre es einfach anzupassen daraus zB. ne Ampelsteuerung zu machen -> die Fragestellung würde aber nicht zwingend genau genug sein um Datenschutzmässig nen Problem zu haben. Oder zB. fürs Programmieren "baue mir folgende Funktion rekursiv um" -> um sich dann das ganze anzugucken, hatte in dem Fall sogar eine wirklich schöne Lösung ergeben... Ich würde eben NICHT einfach per Copy/Paste den Code einfügen und ausführen, sondern immer noch mittels HI (Human Intelligence) mal drübergucken -> wenn es genug Leute gibt die behaupten nen "rm -rf /" würde unter Linux das System optimieren würde eine KI das eben auch so wiedergeben -> was ganz sicher NICHT korrekt ist. Und wenn die Lösung etwas komplexer aussieht dann wirds umso wichtiger mal drüber zu gucken... Aber sich einer neuen Technik verschließen dürfte grad in diesem Fall eher kurzsichtig sein - da es sich eben mehr und mehr in den Alltag schieben wird...

Zitat von @heilgecht:

Ich bin ein 3rd-level Administrator und KI hat kein Platz in meiner Arbeit.

Die Probleme die ich löse sind zu spezifisch. Skripte schreiben tue ich selten, und wenn ich muss, dann freuhe ich mich richtig wenn ich das selbst machen darf.

Das Selbe mit E-Mails, sich richtig auszudrücken ist eine Fähigkeit die stätig trainiert werden muss.

Selbst englischsprachige Texte verfasse ich lieber selbst um das nicht zu verlernen.

Die Antworten die KI mir und meinen Kollegen liefert sind oft falsch oder passen nicht zum Kontext.

MfG Oldschool-Admin

Nachtrag: KI wurde an Web-Inhalten trainiert, Foren, Blogs, usw.. Viele Foren und Blogs leben von der Werbung und echten Besuchern, KI nimmt diesen Traffic von den Foren weg und die Werbe-Einnahmen versickern. Langfristig drohen diese Informationsquellen zu verschwinden und wir verlieren neu generiertes Wissen.

Ich bin ein 3rd-level Administrator und KI hat kein Platz in meiner Arbeit.

Die Probleme die ich löse sind zu spezifisch. Skripte schreiben tue ich selten, und wenn ich muss, dann freuhe ich mich richtig wenn ich das selbst machen darf.

Das Selbe mit E-Mails, sich richtig auszudrücken ist eine Fähigkeit die stätig trainiert werden muss.

Selbst englischsprachige Texte verfasse ich lieber selbst um das nicht zu verlernen.

Die Antworten die KI mir und meinen Kollegen liefert sind oft falsch oder passen nicht zum Kontext.

MfG Oldschool-Admin

Nachtrag: KI wurde an Web-Inhalten trainiert, Foren, Blogs, usw.. Viele Foren und Blogs leben von der Werbung und echten Besuchern, KI nimmt diesen Traffic von den Foren weg und die Werbe-Einnahmen versickern. Langfristig drohen diese Informationsquellen zu verschwinden und wir verlieren neu generiertes Wissen.

... KI nimmt inhalte weg? Also - wenn du soooo oldschool bist -> kommen die folgende Aussagen bekannt vor?

"Recording kills Music" (Anfänge der Kassetten und entsprechender Aufnahmegeräte)

"MP3 wird Musik töten" (als dann MP3 rauskam)

"Filesharing wird die Film- und Musikindustrie zerstören" (Napster, Bittorrent,... suchs dir aus)

"Internet wird die Presse zerstören" (speziell über Newsseiten), kurz später "Paywalls zerstören das Internet"...

Und das ist jetzt nur ein kurzer Auszug von dem was alles schon zerstört wurde und verschwunden ist... ist jetzt etwas merkwürdig weil allein beim Schreiben hier aus meinem Kopfhörer irgendwas rauskommt was sich wie Musik anhört - aber die ist ja schon seid mind. irgendwo so um 80er Jahre tod?!?

KI löst in erster Linie Delegierungsprobleme: Häufig ist klar, dass etwas geht und wie es geht. Diejenigen, denen das klar ist, haben aber derzeit nicht die Aufgabe, es selbst umzusetzen, weil das wirtschaftlich und zeitlich unmöglich ist.

Die Bearbeitung der Teilschritte in Team-Strukturen erfordert vorab schon einen großen Zeiteinsatz zur Abstimmung und zum Erreichen eines gemeinsamen Verständnisses. Zurück kommen Resultate unterschiedlicher Qualität: Fehlende Kommentare, fehlende Erläuterung/Dokumentation, hochfragile funktionale Minima ohne Fehler-/Ausnahmenbehandlung, Stückwerke aus Schnipseln von Stack Overflow und Co, gern auch Tabs und Leerzeichen gemischt, um keinen Zweifel am eigenen Arbeitseinsatz zu lassen.

Das kann KI in den verbreiteten Skript- und Programmiersprachen anhand isolierter Probleme schon besser. Es hat also keinen Zweck, sich dem zu verweigern, weil man zukünftig Arbeitsaufträge im eigenen Interesse entweder heruntergebrochen direkt an KI stellt oder - bei komplexeren Problemen - an Menschen, die KI bedienen können. Die Arbeiter mit Schaufeln und ihr Vorarbeiter werden durch Baggerfahrer ersetzt.

Eine Stärke von LLMs ist die Kombination von reichlich vorhandenem Faktenwissen. Alles, was anhand umfassender Dokumentation lösbar ist, wird für meine Zwecke verlässlich gelöst, z.B. PowerShell, Bash, Python, Cloud- und Netzwerk-CLIs. Auch verbreitete Logik- oder Effizienzkniffe in C/C++ werden gut integriert. Die "zweite Meinung" und die manchmal damit verbundene Überraschung sind dem Weg zu einer eleganten Lösung sehr hilfreich.

Bei Instruktionen für eher selten verwendete Tools werden Funktionen und Parameter erfunden. Dann ist auch nach Korrektur in der Regel kein Weiterkommen.

Über die Prompts muss man sich etwas Gedanken machen, um keine Suggestivfragen einzubauen und sich der eigentlichen Frage in Schritten zu nähern. Die Erwartung, ein Problem, für das ich KI verwende, durch eine einzelne Frage zu lösen, habe ich in der Regel nicht.

Datenschutz und Compliance sind keine KI-spezifischen Themen, sondern stellen sich genauso für Suchanfragen und Forenbeiträge. Unternehmen haben die Infrastruktur und Prozesse, das zu kontrollieren oder sie haben sie nicht. KI bietet nun zumindest die Chance, das, was bislang das Unternehmen über die genannten Kanäle verließ, intern zu halten.

Grüße

Richard

Die Bearbeitung der Teilschritte in Team-Strukturen erfordert vorab schon einen großen Zeiteinsatz zur Abstimmung und zum Erreichen eines gemeinsamen Verständnisses. Zurück kommen Resultate unterschiedlicher Qualität: Fehlende Kommentare, fehlende Erläuterung/Dokumentation, hochfragile funktionale Minima ohne Fehler-/Ausnahmenbehandlung, Stückwerke aus Schnipseln von Stack Overflow und Co, gern auch Tabs und Leerzeichen gemischt, um keinen Zweifel am eigenen Arbeitseinsatz zu lassen.

Das kann KI in den verbreiteten Skript- und Programmiersprachen anhand isolierter Probleme schon besser. Es hat also keinen Zweck, sich dem zu verweigern, weil man zukünftig Arbeitsaufträge im eigenen Interesse entweder heruntergebrochen direkt an KI stellt oder - bei komplexeren Problemen - an Menschen, die KI bedienen können. Die Arbeiter mit Schaufeln und ihr Vorarbeiter werden durch Baggerfahrer ersetzt.

Eine Stärke von LLMs ist die Kombination von reichlich vorhandenem Faktenwissen. Alles, was anhand umfassender Dokumentation lösbar ist, wird für meine Zwecke verlässlich gelöst, z.B. PowerShell, Bash, Python, Cloud- und Netzwerk-CLIs. Auch verbreitete Logik- oder Effizienzkniffe in C/C++ werden gut integriert. Die "zweite Meinung" und die manchmal damit verbundene Überraschung sind dem Weg zu einer eleganten Lösung sehr hilfreich.

Bei Instruktionen für eher selten verwendete Tools werden Funktionen und Parameter erfunden. Dann ist auch nach Korrektur in der Regel kein Weiterkommen.

Über die Prompts muss man sich etwas Gedanken machen, um keine Suggestivfragen einzubauen und sich der eigentlichen Frage in Schritten zu nähern. Die Erwartung, ein Problem, für das ich KI verwende, durch eine einzelne Frage zu lösen, habe ich in der Regel nicht.

Datenschutz und Compliance sind keine KI-spezifischen Themen, sondern stellen sich genauso für Suchanfragen und Forenbeiträge. Unternehmen haben die Infrastruktur und Prozesse, das zu kontrollieren oder sie haben sie nicht. KI bietet nun zumindest die Chance, das, was bislang das Unternehmen über die genannten Kanäle verließ, intern zu halten.

Grüße

Richard

Das Selbe mit E-Mails, sich richtig auszudrücken ist eine Fähigkeit die stätig trainiert werden muss.

Dieser Satz hat mir ziemliche Freude bereitet :DVielleicht hätte eine KI hier keinen Schreibfehler eingebaut /shrug

onTopic:

yes. Solange ich selbst die Dinge validieren kann, finde ich das brauchbar. Blind darauf verlassen, kann man sich nicht.

Gruß

Zitat von @heilgecht:

Ich bin ein 3rd-level Administrator und KI hat kein Platz in meiner Arbeit.

Die Probleme die ich löse sind zu spezifisch. Skripte schreiben tue ich selten, und wenn ich muss, dann freuhe ich mich richtig wenn ich das selbst machen darf.

Ich bin ein 3rd-level Administrator und KI hat kein Platz in meiner Arbeit.

Die Probleme die ich löse sind zu spezifisch. Skripte schreiben tue ich selten, und wenn ich muss, dann freuhe ich mich richtig wenn ich das selbst machen darf.

seh ich genauso, bei meinem problemen hat mir die KI bisher noch NULL mal helfen können.

Klar hab ichs versucht, aber wenn du dann irgendwann nach 1-2 Stunden rumtesten feststellst das sie nur schwachsinn von sich gibt und sich ständig im kreis dreht... dann regt man sich irgendwann drübert auf.

Und wenn man die antworten mit Google suche vergleicht kommt im prinzip genau das selbe raus, nur das man bei den google "funden" schon an den URLs oder textpassagen die vorgeblendet weiss das dort die antwort nicht zu finden ist....

Und wenn man sie dann drauf aufmerksam macht, dann gibt sie zu das sie keinen schimmer hat...

Beispiel war bei mir Switch Konfig anpassen und kleinere Cisco Switche haben nicht alle Befehle wie die grossen.

Die KI sagte ständig man muss dann das Default Login und Default Passwort benutzen/setzen. Unter uns? Default Passwort hört sich doch so an das man das anpassen kann oder?

tja geht halt nicht, aber hauptsache sie labberte 2 Stunden denn schrott bis ich dann endgültig die anleitung selbst in die hand nahm und das dann bestätigte das das nicht möglich ist zu verändern....

Und selbst bei so kleinigkeiten eigentlich happerts schon, von komplexeren Problemen reden wir lieber nicht....

Intelligenz ist was anderes wie Zusammenfassungen der Google Suche von sich zu geben mit ignoranz von spezifischen suchkriterien die man eigentlich mitteilt....

Egal mein Job scheint nicht gefährdet zu sein

Ich Google lieber...

Beim Scripten - ja ist ok ganz hilfreich.... aber nichts was man mit Google nicht hinbekommt...

von dem her Gott bewahre das so Management Fizzies nicht das Firmenwohl an ne KI abgeben...

weil dann ist mir zumindest klar was passieren wird...

von dem her Gott bewahre das so Management Fizzies nicht das Firmenwohl an ne KI abgeben...

weil dann ist mir zumindest klar was passieren wird...Immerhin sprichst Du diesen "Fizzies" ganz offensichtlich ein höheres Maß an Fähigkeiten zu als der KI. Das ist aus Techniker-Sicht ja nicht selbstverständlich 😉

@maretz

Und "erst im 15ten Anlauf gelöst" - nun, vergleichen wir das mal mit einigen Fragestellungen hier die von Menschen beantwortet werden, da sind 15 Anläufe doch gar nicht mal sooo schlecht!

Ich war letzten Endes zufrieden, dass die KI es geschafft hat, denn ich hätte es nicht gekonnt. Ärgerlich war nur, dass er mit jeder Korrektur auf's Neue beteuert hat, "jetzt aber wirklich das Problem erkannt zu haben" und sogar von "getesteten" ("proven") Lösungen sprach, die ganz bestimmt funktionieren. Er machte auch schreckliche Anfängerfehler, wie am Ende vom Skript eine Zeile einzubauen, die per Meldung mitsamt grünem Haken Erfolg suggerierte, ohne dabei überhaupt den Errorlevel abzufragen *stirnklatsch*Zitat von @maretz:

... KI nimmt inhalte weg? Also - wenn du soooo oldschool bist -> kommen die folgende Aussagen bekannt vor?

"Recording kills Music" (Anfänge der Kassetten und entsprechender Aufnahmegeräte)

"MP3 wird Musik töten" (als dann MP3 rauskam)

"Filesharing wird die Film- und Musikindustrie zerstören" (Napster, Bittorrent,... suchs dir aus)

"Internet wird die Presse zerstören" (speziell über Newsseiten), kurz später "Paywalls zerstören das Internet"...

Und das ist jetzt nur ein kurzer Auszug von dem was alles schon zerstört wurde und verschwunden ist... ist jetzt etwas merkwürdig weil allein beim Schreiben hier aus meinem Kopfhörer irgendwas rauskommt was sich wie Musik anhört - aber die ist ja schon seid mind. irgendwo so um 80er Jahre tod?!?

... KI nimmt inhalte weg? Also - wenn du soooo oldschool bist -> kommen die folgende Aussagen bekannt vor?

"Recording kills Music" (Anfänge der Kassetten und entsprechender Aufnahmegeräte)

"MP3 wird Musik töten" (als dann MP3 rauskam)

"Filesharing wird die Film- und Musikindustrie zerstören" (Napster, Bittorrent,... suchs dir aus)

"Internet wird die Presse zerstören" (speziell über Newsseiten), kurz später "Paywalls zerstören das Internet"...

Und das ist jetzt nur ein kurzer Auszug von dem was alles schon zerstört wurde und verschwunden ist... ist jetzt etwas merkwürdig weil allein beim Schreiben hier aus meinem Kopfhörer irgendwas rauskommt was sich wie Musik anhört - aber die ist ja schon seid mind. irgendwo so um 80er Jahre tod?!?

Bezogen auf IT Thematik gehen die Inhalte definitiv verloren. Wir konnten gerade beobachten wie die richtige Problemlösungen oder einfach nur Kommentare von Stackoverflow oder Reddit von den Verfassern gelöscht wurden.

Naja - auch da is die KI ja nichts anderes als der menschliche Kollege auch... Wenn du nämlich rumgehst und da fragst ist sich auch jeder Kollege entweder

- völlig sicher das es genau SO ist und NUR so gelöst werden kann

oder

- kennt das problem nicht aber es _muss_ genau SO gelöst werden

Und das natürlich dabei jede Lösung 20x getestet wurde is ja klar - und nur diesmal gehts wohl nich aber da hast du wohl was falsch verstanden...

Also - das hört sich für mich immer mehr und mehr danach an das die KI doch schon sehr dicht an den menschlichen Kollegen ist...

Aber spass beiseite -> natürlich hat die auch nachteile, Mir erklärt die eben auch das ich irgendwelche Maven-Dinge nutzen soll mit Modulen die bereits veraltet sind...Liegt eben daran das dieses oft genug genutzt wurde und die statistik halt sagt "nimm das"... DAS ist für mich eben die "geistige Transferleistung" die heute immer noch nötig ist (und vermutlich auch bleibt) - da einfach was reinhauen und es kommt mundgerecht raus geht halt nicht, man muss immernoch wissen WAS das Ergebnis bedeutet... MIR spart es eben das ich 20 Seiten Google öffnen muss (wo auch jeder sagt das er/sie/es genau DIE perfekte Lösung hatte), mir die Lösungen ansehen und dabei eben genauso die veralteten / falschen Lösungen ausfiltern muss...

- völlig sicher das es genau SO ist und NUR so gelöst werden kann

oder

- kennt das problem nicht aber es _muss_ genau SO gelöst werden

Und das natürlich dabei jede Lösung 20x getestet wurde is ja klar - und nur diesmal gehts wohl nich aber da hast du wohl was falsch verstanden...

Also - das hört sich für mich immer mehr und mehr danach an das die KI doch schon sehr dicht an den menschlichen Kollegen ist...

Aber spass beiseite -> natürlich hat die auch nachteile, Mir erklärt die eben auch das ich irgendwelche Maven-Dinge nutzen soll mit Modulen die bereits veraltet sind...Liegt eben daran das dieses oft genug genutzt wurde und die statistik halt sagt "nimm das"... DAS ist für mich eben die "geistige Transferleistung" die heute immer noch nötig ist (und vermutlich auch bleibt) - da einfach was reinhauen und es kommt mundgerecht raus geht halt nicht, man muss immernoch wissen WAS das Ergebnis bedeutet... MIR spart es eben das ich 20 Seiten Google öffnen muss (wo auch jeder sagt das er/sie/es genau DIE perfekte Lösung hatte), mir die Lösungen ansehen und dabei eben genauso die veralteten / falschen Lösungen ausfiltern muss...

Zitat von @shebang:

Vielleicht hätte eine KI hier keinen Schreibfehler eingebaut /shrug

onTopic:

yes. Solange ich selbst die Dinge validieren kann, finde ich das brauchbar. Blind darauf verlassen, kann man sich nicht.

Gruß

Das Selbe mit E-Mails, sich richtig auszudrücken ist eine Fähigkeit die stätig trainiert werden muss.

Dieser Satz hat mir ziemliche Freude bereitet :DVielleicht hätte eine KI hier keinen Schreibfehler eingebaut /shrug

onTopic:

yes. Solange ich selbst die Dinge validieren kann, finde ich das brauchbar. Blind darauf verlassen, kann man sich nicht.

Gruß

Wer Schreibfehler findet, darf sie behalten, Deutsch ist nicht meine Muttersprache.

Das kann ich mir jetzt natürlich nicht verkneifen 😇:

ChatGPT:

Finde bitte alle Fehler in diesem Satz (Rechtschreibung und Grammatik):

"Das Selbe mit E-Mails, sich richtig auszudrücken ist eine Fähigkeit die stätig trainiert werden muss."

PS: Wenigstens für "Rechtschreib-Nadsis" ist ChatGPT also ne feine Sache ... und da würde ich "dasselbe" immer noch zur Diskussion stellen wollen (das gleiche, passt imho besser in so einer Art Vergleich)

ChatGPT:

Finde bitte alle Fehler in diesem Satz (Rechtschreibung und Grammatik):

"Das Selbe mit E-Mails, sich richtig auszudrücken ist eine Fähigkeit die stätig trainiert werden muss."

Der Satz enthält mehrere Fehler in Rechtschreibung, Zeichensetzung und Grammatik. Hier ist die korrigierte Version:

Korrigierter Satz:

> "Dasselbe mit E-Mails: Sich richtig auszudrücken, ist eine Fähigkeit, die stetig trainiert werden muss."

Fehleranalyse:

1. „Das Selbe“ → „Dasselbe“:

* „Dasselbe“ ist ein Indefinitpronomen und wird zusammengeschrieben.

* „Das Selbe“ ist falsch, weil „selbe“ ein Adjektiv wäre, das hier aber nicht korrekt verwendet ist.

2. Komma nach „E-Mails“:

* Ein Doppelpunkt ist hier passender, da eine Erklärung oder Konkretisierung folgt.

* Ein Komma wäre auch grammatikalisch korrekt, aber stilistisch schwächer.

3. „sich richtig auszudrücken ist eine Fähigkeit“ → „Sich richtig auszudrücken, ist eine Fähigkeit“:

* Der Infinitiv mit „zu“ ist ein erweiterter Infinitiv und benötigt ein Komma.

* „Sich“ wird am Satzanfang großgeschrieben.

4. Komma vor „die stetig trainiert werden muss“:

* Relativsätze werden durch ein Komma abgetrennt.

5. „stätig“ → „stetig“:

* „Stetig“ bedeutet „andauernd, regelmäßig“ – das ist hier gemeint.

* „Stätig“ ist eine veraltete, heute nicht mehr gebräuchliche oder falsche Form.PS: Wenigstens für "Rechtschreib-Nadsis" ist ChatGPT also ne feine Sache ... und da würde ich "dasselbe" immer noch zur Diskussion stellen wollen (das gleiche, passt imho besser in so einer Art Vergleich)

Zitat von @heilgecht:

Bezogen auf IT Thematik gehen die Inhalte definitiv verloren. Wir konnten gerade beobachten wie die richtige Problemlösungen oder einfach nur Kommentare von Stackoverflow oder Reddit von den Verfassern gelöscht wurden.

Bezogen auf IT Thematik gehen die Inhalte definitiv verloren. Wir konnten gerade beobachten wie die richtige Problemlösungen oder einfach nur Kommentare von Stackoverflow oder Reddit von den Verfassern gelöscht wurden.

Wo gehen die durch KI verloren? Fangen wir mal einfach an KI kann eben nur auswerten. D.h. damit die überhaupt was aufnehmen kann MUSS die Lösung eben schonmal irgendwo stehen. Wenn du zB. die KI danach fragst dir die Konstruktion für eine Solarzelle mit 100% Wirkungsgrad zu geben wird dir dir auch keine (sinnvolle) Lösung erzeugen. Damit kann also erstmal schon nur das "Wissen" verloren gehen was sich irgendwo oft genug wiederholt hat... Die "Inhalte" wären also erstmal nur Wiederholungen...

Dazu kommt: Natürlich wird sich auch für Foren usw. einiges ändern - überraschung, das Leben IST Veränderung. Die reine präsentation von (mehr oder weniger) statischen Inhalten wird halt nicht mehr ausreichen. DAS ist wiederum mit zB. Musik vergleichbar - es wird heute eben nicht mehr reichen nur irgendwo ne CD aufm Markt zu werfen. Das ganze geht eben weiter - sei es Konzerte, sei es Playlists wie Amazon Prime, Spotify,... wo der Kunde das auch unterwegs problemlos hören kann. Oder sei es als Musikvideo bei Youtube. Das ganze dann gepaart mit den entsprechenden Endgeräten und der Kunde bekommt was er/sie/es will -> ich kann eben meinem Endgerät sogar sprachlich mitteilen es solle doch jetzt bitte Lied X von Artist Y spielen - und los gehts...

Warum sollte sich das im Netz anders verhalten? Eine relativ statische Seite die Texte in ner DB speichert und wieder rausholt wird so sicher nicht für die Unendlichkeit sein - und es würde mich wundern wenn ein Seitenbetreiber das annimmt. Ein Benutzer muss erst aktiv auf eine Seite gehen, sich ggf. noch anmelden, dann tonnenweise Text lesen, ggf. nicht mal irgendwie vorgefiltert auf "hilfreich", "nicht hilfreich",.. - da ist klar das eine KI hier ne bequeme Alternative bietet und die Option "stell mir ne Frage in normaler Fragestellung und lass mich für dich durch die Gegend laufen" sehr verlockend ist. Aber es liegt jetzt eben auch bei den Seitenbetreibern dafür zu sorgen das die eben (siehe oben, analog zur musik) einen Mehrwert bieten und sich überlegen welche Vorteile die haben..

Und ja - es werden auch Inhalte und Seiten natürlich verschwinden... und an anderer Stelle wieder neue Dinge auftauchen... DAS ist die tägliche Veränderung im Web, das ist ja jetzt nix ungewöhnliches mehr...

Ok - also wenn ich das jetzt richtig überflogen habe - Stack-Overflow spielt mit AI zusammen, die Benutzer löschen Content aber das ist die Schuld von AI? Finde ich schon etwas "spannend" als Theorie. Denn: Wenn morgen Frank auf die Idee kommt zu sagen er nimmt die Inhalte von hier für das Administrator-Magazin und ich meine Inhalte dann aus protest lösche - dann hat nicht das Magazin meine Inhalte gelöscht, das Magazin ist auch nicht verantwortlich das Inhalte verschwinden, ICH bin dafür verantwortlich. Und auch da: Es steht mir ja frei das zu tun weil ich das ggf. nicht unterstützen will - ABER wenn es dann nicht der Grund "Magazin" ist, dann eben "AI" oder irgendein Benutzer der mir nicht passt, ... Am Ende würde ich sagen es ist wenn überhaupt die "Schuld" des Seiten-Betreibers - nämlich wie man es "verkauft" und welche Möglichkeiten es gibt. Es wäre ja GRADE bei einer gewollten Zusammenarbeit ein leichtes zu sagen "ich mach nen Flag - wenn ein Benutzer nicht will setzt er das und seine Inhalte gehen nicht an AI"

Also - aus meiner sicht sind die Inhalte eben nicht durch AI verloren gegangen, sondern durch Menschen...

Also - aus meiner sicht sind die Inhalte eben nicht durch AI verloren gegangen, sondern durch Menschen...

Moin,

wie immer mit so neuen Technologien: mal schauen, wohin es sich entwickelt. Es gibt Bereiche, da ist es hilfreich, in anderen nicht.

Programmierung: klar, klasse, weil da so ein riesiger Fundus zugrunde liegt, dass da wirklich brauchbare Gerüste oder Module herauskommen.

Problem: wenn denn ein Fehler drin ist, muss einem der auffallen. Alles zu kontrollieren, frisst den gewonnenen Zeitvorteil wieder auf.

Ist mir gerade hier erst passiert. User hat KI-Script gepostet, drüber geschaut, kurze Anmerkungen zur ersten Fassung = Murks gegeben und hingewiesen, warum man bei KI mitdenken soll. Anderer User postet KI-überarbeitetes Skript. Sieht gut aus, alle wesentlichen Baustellen auf den ersten Blick beseitigt. Aber: war doch ein Logikfehler drin. Eigentlich einfach zu sehen, aber da hatte ich auch "abgeschaltet" getreu dem Motto: das bekommt KI doch hin. Nein. Und da ist es halt schwierig.

In einem gänzlich anderen Bereich letzte Woche erst im Umfeld erlebt: KI hat eine Zusammenfassung mit hochgeladenem Quellenmaterial geliefert und gem. Aufgabenstellung ausgewertet. Bei händischer Durchsicht aufgefallen: die geforderten Zitatet aus der Quelle waren richtig (inhaltlich + wörtlich), hatten aber falsche Seitenzahlen. Warum? Die Quelle war auf A3 (Druckvorlage) skaliert mit links und rechts jeweils einer A4-Seite mit eigener Seitenzahl. Das ging in die Hose. Ungeprüft übernommen wäre großer Mist. Allerdings war das Grundgerüst beeindruckend und eine große Zeitersparnis.

Wo KI, wenn man es braucht, ebenfalls sehr gut hilft: Generieren copyright-freier Bilder im geschäftlichen Bereich. Das wird immer besser.

Gruß

DivideByZero

wie immer mit so neuen Technologien: mal schauen, wohin es sich entwickelt. Es gibt Bereiche, da ist es hilfreich, in anderen nicht.

Programmierung: klar, klasse, weil da so ein riesiger Fundus zugrunde liegt, dass da wirklich brauchbare Gerüste oder Module herauskommen.

Problem: wenn denn ein Fehler drin ist, muss einem der auffallen. Alles zu kontrollieren, frisst den gewonnenen Zeitvorteil wieder auf.

Ist mir gerade hier erst passiert. User hat KI-Script gepostet, drüber geschaut, kurze Anmerkungen zur ersten Fassung = Murks gegeben und hingewiesen, warum man bei KI mitdenken soll. Anderer User postet KI-überarbeitetes Skript. Sieht gut aus, alle wesentlichen Baustellen auf den ersten Blick beseitigt. Aber: war doch ein Logikfehler drin. Eigentlich einfach zu sehen, aber da hatte ich auch "abgeschaltet" getreu dem Motto: das bekommt KI doch hin. Nein. Und da ist es halt schwierig.

In einem gänzlich anderen Bereich letzte Woche erst im Umfeld erlebt: KI hat eine Zusammenfassung mit hochgeladenem Quellenmaterial geliefert und gem. Aufgabenstellung ausgewertet. Bei händischer Durchsicht aufgefallen: die geforderten Zitatet aus der Quelle waren richtig (inhaltlich + wörtlich), hatten aber falsche Seitenzahlen. Warum? Die Quelle war auf A3 (Druckvorlage) skaliert mit links und rechts jeweils einer A4-Seite mit eigener Seitenzahl. Das ging in die Hose. Ungeprüft übernommen wäre großer Mist. Allerdings war das Grundgerüst beeindruckend und eine große Zeitersparnis.

Wo KI, wenn man es braucht, ebenfalls sehr gut hilft: Generieren copyright-freier Bilder im geschäftlichen Bereich. Das wird immer besser.

Gruß

DivideByZero

Moin,

das Problem von KI ist, dass die User (bald) keine Lust mehr haben (werden), irgendwas ins Internet zu stellen, wenn sie keine Klicks und damit Ruf und Geld generieren können, da die KI das ja bereits eingesaugt hat und in einem "Chat" einfach auskotzt. Wozu sollte ich BornsBlog noch ansurfen, wenns ein einfaches Prompt auch hergibt? Ggf. sogar kürzer aber prägnanter?

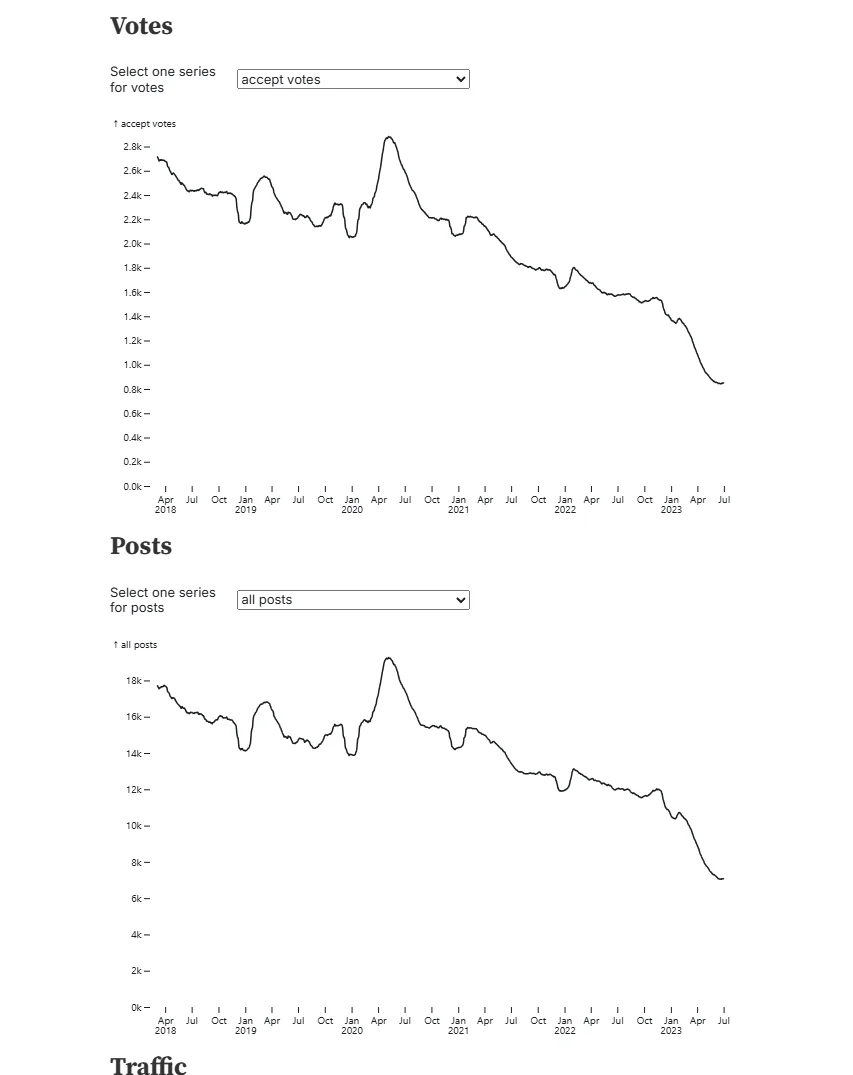

Das kann ich komplett nachvollziehen und sehe auch, warum bspw. SO damit ernsthafte Probleme bekommen könnte/wird. Gibt bereits Stats (sorry, wenn ich eure Links nicht gelesen hab) online, die belegen dass online "Fragen und Antworten" massiv zurückgehen.

Denn: ohne Menschen (und deren Intelligenz), gäbe es keine KI(bzw. sie hätte keinen Content). Ohne uns - keine KI.

KI sorgt aber dafür, dass wir bald nichts mehr online stellen werden, weil: warum auch!? Das Individuum hat nichts mehr davon.

Also: Je mehr KI, desto weniger KI? Paradox.

Gruß

Edita:

das Problem von KI ist, dass die User (bald) keine Lust mehr haben (werden), irgendwas ins Internet zu stellen, wenn sie keine Klicks und damit Ruf und Geld generieren können, da die KI das ja bereits eingesaugt hat und in einem "Chat" einfach auskotzt. Wozu sollte ich BornsBlog noch ansurfen, wenns ein einfaches Prompt auch hergibt? Ggf. sogar kürzer aber prägnanter?

Das kann ich komplett nachvollziehen und sehe auch, warum bspw. SO damit ernsthafte Probleme bekommen könnte/wird. Gibt bereits Stats (sorry, wenn ich eure Links nicht gelesen hab) online, die belegen dass online "Fragen und Antworten" massiv zurückgehen.

Denn: ohne Menschen (und deren Intelligenz), gäbe es keine KI(bzw. sie hätte keinen Content). Ohne uns - keine KI.

KI sorgt aber dafür, dass wir bald nichts mehr online stellen werden, weil: warum auch!? Das Individuum hat nichts mehr davon.

Also: Je mehr KI, desto weniger KI? Paradox.

Gruß

Edita:

Stimme ich zu! Es heißt nämlich stetig face-wink

shhhhh ;)

Ich bin eine Ein-Mann Firma und betreue Kunden in der Größenordnung 1-30 Arbeitsplätze.

Ich nutze KI nun häufiger für Websuchen - die Suchmaschinen sind durch SEO Tuning und allgegenwärtige Werbung fast komplett nutzlos geworden. Daneben finde ich es sehr lehrreich, wenn man sich kleinere Scripte schreiben und erklären lässt, auch weil es schnell geht und man - im Gegensatz zu Forenpostings - direkt Feedback bekommt.

Ich nutze Grok (ist in meinem X Abo drin), ChatGPT und Perplexity (gab es mal für ein Jahr kostenlos für Telekom Kunden). Aber ich nutze diese Tools immer noch eher selten, mir ist die Kommunikation mit echten Menschen lieber. Trotzdem finde ich die Technologie beindruckend, habe aber auch gehörigen Respekt davor. Ich hoffe einfach nur, dass das nicht alles aus dem Ruder läuft.

Ich nutze KI nun häufiger für Websuchen - die Suchmaschinen sind durch SEO Tuning und allgegenwärtige Werbung fast komplett nutzlos geworden. Daneben finde ich es sehr lehrreich, wenn man sich kleinere Scripte schreiben und erklären lässt, auch weil es schnell geht und man - im Gegensatz zu Forenpostings - direkt Feedback bekommt.

Ich nutze Grok (ist in meinem X Abo drin), ChatGPT und Perplexity (gab es mal für ein Jahr kostenlos für Telekom Kunden). Aber ich nutze diese Tools immer noch eher selten, mir ist die Kommunikation mit echten Menschen lieber. Trotzdem finde ich die Technologie beindruckend, habe aber auch gehörigen Respekt davor. Ich hoffe einfach nur, dass das nicht alles aus dem Ruder läuft.

Zitat von @maretz:

Ok - also wenn ich das jetzt richtig überflogen habe - Stack-Overflow spielt mit AI zusammen, die Benutzer löschen Content aber das ist die Schuld von AI? Finde ich schon etwas "spannend" als Theorie. Denn: Wenn morgen Frank auf die Idee kommt zu sagen er nimmt die Inhalte von hier für das Administrator-Magazin und ich meine Inhalte dann aus protest lösche - dann hat nicht das Magazin meine Inhalte gelöscht, das Magazin ist auch nicht verantwortlich das Inhalte verschwinden, ICH bin dafür verantwortlich. Und auch da: Es steht mir ja frei das zu tun weil ich das ggf. nicht unterstützen will - ABER wenn es dann nicht der Grund "Magazin" ist, dann eben "AI" oder irgendein Benutzer der mir nicht passt, ... Am Ende würde ich sagen es ist wenn überhaupt die "Schuld" des Seiten-Betreibers - nämlich wie man es "verkauft" und welche Möglichkeiten es gibt. Es wäre ja GRADE bei einer gewollten Zusammenarbeit ein leichtes zu sagen "ich mach nen Flag - wenn ein Benutzer nicht will setzt er das und seine Inhalte gehen nicht an AI"

Also - aus meiner sicht sind die Inhalte eben nicht durch AI verloren gegangen, sondern durch Menschen...

Ok - also wenn ich das jetzt richtig überflogen habe - Stack-Overflow spielt mit AI zusammen, die Benutzer löschen Content aber das ist die Schuld von AI? Finde ich schon etwas "spannend" als Theorie. Denn: Wenn morgen Frank auf die Idee kommt zu sagen er nimmt die Inhalte von hier für das Administrator-Magazin und ich meine Inhalte dann aus protest lösche - dann hat nicht das Magazin meine Inhalte gelöscht, das Magazin ist auch nicht verantwortlich das Inhalte verschwinden, ICH bin dafür verantwortlich. Und auch da: Es steht mir ja frei das zu tun weil ich das ggf. nicht unterstützen will - ABER wenn es dann nicht der Grund "Magazin" ist, dann eben "AI" oder irgendein Benutzer der mir nicht passt, ... Am Ende würde ich sagen es ist wenn überhaupt die "Schuld" des Seiten-Betreibers - nämlich wie man es "verkauft" und welche Möglichkeiten es gibt. Es wäre ja GRADE bei einer gewollten Zusammenarbeit ein leichtes zu sagen "ich mach nen Flag - wenn ein Benutzer nicht will setzt er das und seine Inhalte gehen nicht an AI"

Also - aus meiner sicht sind die Inhalte eben nicht durch AI verloren gegangen, sondern durch Menschen...

Immer mehr Menschen fragen KI Bots anstatt hier im Forum zu schreiben. Forum wird weniger besucht, dadurch werden weniger neue Inhalte generiert bis das Forum kompett schließt. KI gewinnt, bekommt aber zukünftig kein neues Wissen. Wir alle sind dadurch im Nachteil.

Immer mehr Menschen fragen KI Bots anstatt hier im Forum zu schreiben. Forum wird weniger besucht, dadurch werden weniger neue Inhalte generiert

Sehe ich auch so, siehe z.B. Stack Overflow

Dazu kommt auch, dass Chatbots auf diversen Plattformen (qualitativ minderwertig) posten, was in Zukunft für das Training neuer LLMs verwendet wird.. ein Teufelskreis.

Zitat von @heilgecht:

Immer mehr Menschen fragen KI Bots anstatt hier im Forum zu schreiben. Forum wird weniger besucht, dadurch werden weniger neue Inhalte generiert bis das Forum kompett schließt. KI gewinnt, bekommt aber zukünftig kein neues Wissen. Wir alle sind dadurch im Nachteil.

Immer mehr Menschen fragen KI Bots anstatt hier im Forum zu schreiben. Forum wird weniger besucht, dadurch werden weniger neue Inhalte generiert bis das Forum kompett schließt. KI gewinnt, bekommt aber zukünftig kein neues Wissen. Wir alle sind dadurch im Nachteil.

Deshalb oben der Vergleich zur Musik - dasselbe hat nämlich die Musik-Industrie schon mehrfach gesagt... Einführung der Kassette (mit Aufnahmefunktion), Einführung der CD-R, Musik-Tauschbörsen,...

Ich weiss nicht warum ihr das so nachteilig seht? Also nochmal - ja natürlich, Seiten die sich nicht verändern und/oder einen Mehrwert anbieten bekommen ein Problem. Eben genauso wie der Musiker der ne CD in den Laden wirft und aufs grosse Geld hofft. Genauso wie der 08/15-Händler der versucht gegen Online-Shopping anzukommen. DAS ist keine Erfindung von KI/AI. Und dasselbe gilt für die Webseiten - natürlich wird erstmal weniger gefragt (da die ein oder andere Frage ja eben schon vorher über KI/AI beantwortet wurde). Und natürlich werden auch einige Antworten weniger werden - weil man eben seinen Content nicht morgen bei $AI-Anbieter sehen will, weil man eben ggf. sogar seine Geld "mit Wissen" verdient,... Nur: Genauso wie in jedem anderem Bereich müssen halt die Webseitenbetreiber sich was einfallen lassen wie deren Seite eben auch bei AI trotzdem einen Mehrwert bieten kann. Genauso wie eben der Fachhändler für Elektronik auch heute noch neben MediaMarkt usw, und auch gegen Online-Angebote existiert - da ist es eben die Beratung als Zusatzmerkmal. Bei Musik ist es eben die Möglichkeit heute für nen paar Euro eben NICHT die selbstgebrannte CD (oder sogar Kassette) mitnehmen zu müssen - sondern App starten und laufen lassen. Ich drehe die Frage hier jetzt mal um - wo würden wir heute bei Musik wohl stehen wenn die Industrie eben _nicht_ gezwungen worden sich anzupassen? Wer glaubt die Industrie hätte da freiwillig das "experiment" MP3 und/oder Streaming gewagt?

Ich kann mich also hinstellen und alles schwarz malen. AI/KI zerlegt nicht nur Foren, auch der Job des Admins, SW-Entwicklers,... kann zu einem grossteil damit durch eine "Aushilfe" erledigt werden wenn man nur weiss wie man fragen muss (und selbst das ging auch vor AI/KI schon - wie viele Fragen hier beweisen bei denen Leute Aufträge angenommen haben aber offentsichtlich nicht mal grundlegend verstehen wie es funktioniert). ODER ich sehe es eben Positiv - JA, es wird Veränderungen erzeugen und JA, nicht jede Seite wird das überstehen - aber dafür gibt es eben ggf. wieder einen Mehrwert. Und nehmen wir nur mal diese Seite hier - und ein sehr einfaches Beispiel: NEBEN den Infos gibt es hier ne Jobbörse - ein Teil der bei AI relativ sinnfrei ist da es idR. recht kurzfristige Infos sind bis die Stellen neu vergeben werden. Man könnte jetzt zB. noch nen Schritt weitergehen - "Projektsharing" für die "Einzelkämpfer" hier die mal Urlaub machen wollen oder "Auftragsarbeit" eben für die Leute die mal wieder nen Auftrag angenommen haben aber nich wissen wie es geht... Schon hast du wieder Mehrwerte geschaffen (und ich glaube da gibt es noch erheblich bessere Ideen) - und der kann durch AI eben nich abgelöst werden. Denn bei AI kann ich zwar fragen - aber die wird mir eben schwer sagen können welcher Einzelkämpfer jetzt grad mal ne Woche Zeit hat weil ich grad krank geworden bin aber der Auftrag XYZ nicht warten kann (und nur um es klarzustellen - nein, ich bin nicht selbstständig, ich bin Angestellt... nich das jetzt jemand denkt "oh, der is krank, ich kanns ja mal anbieten"!)...

Und ja - Neue Techniken bringen immer gute und schlechte Veränderungen... Angefangen bei der Entdeckung des Feuers (gab plötzlich warme Nahrung...gut... man konnte dem Nachbarn die Hütte abfackeln... nich so doll... und im Mittelalter soll die ein oder andere Frau auch die Entdeckung des Feuers nich soo geil gefunden haben). Sprengstoffe (in welcher Form auch immer) - im Airbag was gutes, da wo sich aktuell grad wieder irgendwelche Vollidi**en mit Raketen beschiessen eher weniger gut... Warum sollte es bei AI also irgendwie anders laufen?!?

Ich nutz AI-Prompts im Grunde als verbesserte Suchmaschine.

Wenns jetzt sehr spezifisch für die eigene Arbeit ist, wirds eher schwierig, weil die AI da oft gar nix mit anfangen kann.

Aber generell und anonymisiert kann die AI schon den einen oder anderen Schubs in die richtige Richtung geben.

Übersetzungs-AI und Schreib-vernünftig-AI à la Deepl ist aber hin und wieder schon sehr brauchbar, wenns um professionelle Schreiben geht.

Ich seh halt AI als reines Werkzeug. Alles, was ich da als Ausgabe erhalte ist ein Vorschlag. Das ist wie Wikipedia mit verbesserten Suchoptionen.

Mit claude.ai habe ich schon das eine oder andere Zwiegespräch gehalten, wenn mal ein Skript nicht funktioniert. Nicht immer erhalte ich da eine funktionierende Lösung. Aber oftmals ist der gute alte Claude schon brauchbar.

Wenns jetzt sehr spezifisch für die eigene Arbeit ist, wirds eher schwierig, weil die AI da oft gar nix mit anfangen kann.

Aber generell und anonymisiert kann die AI schon den einen oder anderen Schubs in die richtige Richtung geben.

Übersetzungs-AI und Schreib-vernünftig-AI à la Deepl ist aber hin und wieder schon sehr brauchbar, wenns um professionelle Schreiben geht.

Ich seh halt AI als reines Werkzeug. Alles, was ich da als Ausgabe erhalte ist ein Vorschlag. Das ist wie Wikipedia mit verbesserten Suchoptionen.

Mit claude.ai habe ich schon das eine oder andere Zwiegespräch gehalten, wenn mal ein Skript nicht funktioniert. Nicht immer erhalte ich da eine funktionierende Lösung. Aber oftmals ist der gute alte Claude schon brauchbar.

Ich gehöre dann wohl eher zur kritischen Fraktion.....

KI soll stumpfe Fleißarbeiten erledigen.....die kniffligen Dinge, in die ich mich reinfuchsen muss, will ich schon selber machen. Aber selbständiges Denken ist ja heute immer weniger gefragt....warum auch, wo die öffentlichen KI's es den Menschen doch so einfach machen.

Aber so lange die KI nicht meine Wäsche wäscht, das Haus putzt und die Gartenarbeit erledigen kann, ist die für mich im Alltag eher nutzlos.

Just my 2 Cents.

KI soll stumpfe Fleißarbeiten erledigen.....die kniffligen Dinge, in die ich mich reinfuchsen muss, will ich schon selber machen. Aber selbständiges Denken ist ja heute immer weniger gefragt....warum auch, wo die öffentlichen KI's es den Menschen doch so einfach machen.

Aber so lange die KI nicht meine Wäsche wäscht, das Haus putzt und die Gartenarbeit erledigen kann, ist die für mich im Alltag eher nutzlos.

Just my 2 Cents.

Zitat von @Looser27:

Ich gehöre dann wohl eher zur kritischen Fraktion.....

KI soll stumpfe Fleißarbeiten erledigen.....die kniffligen Dinge, in die ich mich reinfuchsen muss, will ich schon selber machen. Aber selbständiges Denken ist ja heute immer weniger gefragt....warum auch, wo die öffentlichen KI's es den Menschen doch so einfach machen.

Aber so lange die KI nicht meine Wäsche wäscht, das Haus putzt und die Gartenarbeit erledigen kann, ist die für mich im Alltag eher nutzlos.

Just my 2 Cents.

Ich gehöre dann wohl eher zur kritischen Fraktion.....

KI soll stumpfe Fleißarbeiten erledigen.....die kniffligen Dinge, in die ich mich reinfuchsen muss, will ich schon selber machen. Aber selbständiges Denken ist ja heute immer weniger gefragt....warum auch, wo die öffentlichen KI's es den Menschen doch so einfach machen.

Aber so lange die KI nicht meine Wäsche wäscht, das Haus putzt und die Gartenarbeit erledigen kann, ist die für mich im Alltag eher nutzlos.

Just my 2 Cents.

Die KI erleichtert/beschleunigt mir einfache Arbeiten (z.B. Skripte schreiben), damit ich mich auf höherwertigere und wichtigere Tätigkeiten konzentrieren kann. Würde die KI arbeiten erledigen können, die ich für mich als hochwertig und wichtig bezeichne, und diese Arbeiten einen Großteil meines Berufs ausmachen, würde ich anfangen mir Sorgen zu machen

Zitat von @Looser27:

Ich gehöre dann wohl eher zur kritischen Fraktion.....

KI soll stumpfe Fleißarbeiten erledigen.....die kniffligen Dinge, in die ich mich reinfuchsen muss, will ich schon selber machen. Aber selbständiges Denken ist ja heute immer weniger gefragt....warum auch, wo die öffentlichen KI's es den Menschen doch so einfach machen.

Aber so lange die KI nicht meine Wäsche wäscht, das Haus putzt und die Gartenarbeit erledigen kann, ist die für mich im Alltag eher nutzlos.

Just my 2 Cents.

Ich gehöre dann wohl eher zur kritischen Fraktion.....

KI soll stumpfe Fleißarbeiten erledigen.....die kniffligen Dinge, in die ich mich reinfuchsen muss, will ich schon selber machen. Aber selbständiges Denken ist ja heute immer weniger gefragt....warum auch, wo die öffentlichen KI's es den Menschen doch so einfach machen.

Aber so lange die KI nicht meine Wäsche wäscht, das Haus putzt und die Gartenarbeit erledigen kann, ist die für mich im Alltag eher nutzlos.

Just my 2 Cents.

Nun - es ist doch einfach: Wirklich "knifflige" Dinge KANN KI/AI nicht lösen - wie auch? Das ding ist am Ende (vereinfacht) statistik - und wenn ich eben ein sehr spezielles Problem ggf. in einer speziellen Umgebung habe gibt es dafür eben keine Statistik die hilft... Und selbst bei weniger speziellen Dingen -> bis man das Problem der KI vollständig erklärt hat ist es ggf. schneller das direkt selbst zu machen, speziell wenn man eben irgendwelche Bedingungen machen muss (die gerne genommene Reinigungskraft die eben nen Stecker zieht -> DAS kann eine AI nicht wirklich lösen da man sich eben ggf. mitm Stuhl neben den Server setzen muss um zu sehen WARUM der Server aus geht ... die KI/AI kann das nunmal nicht).

Zitat von @maretz:

... KI nimmt inhalte weg? Also - wenn du soooo oldschool bist -> kommen die folgende Aussagen bekannt vor?

"Recording kills Music" (Anfänge der Kassetten und entsprechender Aufnahmegeräte)

"MP3 wird Musik töten" (als dann MP3 rauskam)

"Filesharing wird die Film- und Musikindustrie zerstören" (Napster, Bittorrent,... suchs dir aus)

"Internet wird die Presse zerstören" (speziell über Newsseiten), kurz später "Paywalls zerstören das Internet"...

Und das ist jetzt nur ein kurzer Auszug von dem was alles schon zerstört wurde und verschwunden ist... ist jetzt etwas merkwürdig weil allein beim Schreiben hier aus meinem Kopfhörer irgendwas rauskommt was sich wie Musik anhört - aber die ist ja schon seid mind. irgendwo so um 80er Jahre tod?!?

... KI nimmt inhalte weg? Also - wenn du soooo oldschool bist -> kommen die folgende Aussagen bekannt vor?

"Recording kills Music" (Anfänge der Kassetten und entsprechender Aufnahmegeräte)

"MP3 wird Musik töten" (als dann MP3 rauskam)

"Filesharing wird die Film- und Musikindustrie zerstören" (Napster, Bittorrent,... suchs dir aus)

"Internet wird die Presse zerstören" (speziell über Newsseiten), kurz später "Paywalls zerstören das Internet"...

Und das ist jetzt nur ein kurzer Auszug von dem was alles schon zerstört wurde und verschwunden ist... ist jetzt etwas merkwürdig weil allein beim Schreiben hier aus meinem Kopfhörer irgendwas rauskommt was sich wie Musik anhört - aber die ist ja schon seid mind. irgendwo so um 80er Jahre tod?!?

dem entgegne ich:

Denken ist wie Googeln, nur Krasser

Was demnach KI Nutzen ist, was deutlich ne stufe unter Googeln ist... nunja

Und nein, deinen Sätzen oben habe ich nie zugestimmt....

Kollege @maretz, Deine "nichts geht verloren"-Bemerkung ist ein bisschen hingebogen. Natürlich gehen mit jeder vermeintlichen Evolutionsstufe Dinge verloren und die Gefahr besteht immer. Oft werden Dinge nur anders, aber manchmal verschwinden sie auch zum Nachteil der Menschen. Und man merkt den Verlust erst, wenn es zu spät ist.

Oft sind wir zu innovationsbegeistert, um zu merken, was uns genommen wird. Bis es zu spät ist.

Du hast das oben teils schon kurz angesprochen und als normalen Entwicklungsprozess dargestellt. Das ist er aber längst nicht mehr und die KI - bei allem Nutzen - beschleunigt das Problem.

Ich erspare uns hier mögliche Beispiele. Jeder weiß sicher, was ich meine und hat eigene dafür. Die wachsende Prekarisierung einer ehemals (ausgeglichener) auskömmlichen Arbeitswelt ist IMO schon jetzt an jeder Ecke zu betrachten. Lange wurde diese mit dem Begriff der Einkommensschere (eher verharmlosend) umschrieben. Die Prekarisierung der Meinungswelt hat uns den Populismus beschert. Aber bleiben wir @topic:

"KI nimmt Inhalte weg":

Das sehen wir schon real an der Frequenz in diesem Forum - und jeder der KI nutzt, wird das bestätigen (oben sind ja vom Kollegen @CamelCase ja schon ein paar Grafiken zugereicht worden.

Die KI schadet sich - entgegen vielfältiger Auffassung/Hoffnung/Schwarzmalerei - IMO nicht selbst, obgleich sie das Inhaltswachstum des WWW 2.0 bereits jetzt ersichtlich reduziert. Denn: Die KI wächst ja trotzdem - durch die Interaktion mit ihren Usern. Die KI (besser gesagt: Der Konzern) bekommt also weiter den Input. Der Unterschied ist eben, dass nun der Konzern den Input hat - nicht mehr die Allgemeinheit. Das ist doppelt günstig, weil auf diese Weise das Oligopol oder gar Monopol beschleunigt wird, denn wer jetzt nicht dabei ist, wird nie eine Chance auf die selben Inhalte haben.

Wir geben also eine weitere "Open Source-Quelle" auf und begeben uns in die geistige Abhängigkeit von Großkonzernen. Und das auf eine nie dagewesene Weise. Wer sich heute noch etwas Sensitivität dafür gewahrt hat, sieht, wie abhängig die Welt von MS-Word ist, obgleich ganz viele diese Abhängigkeit nicht mögen und es Alternativen gibt. Einzig, aus dem Strudel rauszukommen ist ein Kraftakt, der weit über den Wechsel der Textsoftware hinaus geht. KI ist geeignet derartige Abhängigkeiten schneller und stärker zu erzeugen als je eine Technologie zuvor. Und diese Technologie wird sehr wahrscheinlich am Ende von einem oder wenigen Weltkonzernen dominiert sein.

Das das einigen Sorgen bereitet ist weit weniger verwunderlich als dass es einigen scheinbar keine Sorgen bereitet. Das Problem ist nicht die (Technik der) KI an sich. Das Problem ist, das sie in der Hand von wenigen Konzernen ist und Konzerne (meist) anders mit Menschen/Gesellschaften umgehen, als verteiltere Strukturen. Und wie wir ja hübsch in den USA sehen, besteht eine gewisse Machtaffinität, was die Sorgen nicht mindern dürfte.

Viele Grüße, commodity

Oft sind wir zu innovationsbegeistert, um zu merken, was uns genommen wird. Bis es zu spät ist.

Du hast das oben teils schon kurz angesprochen und als normalen Entwicklungsprozess dargestellt. Das ist er aber längst nicht mehr und die KI - bei allem Nutzen - beschleunigt das Problem.

Ich erspare uns hier mögliche Beispiele. Jeder weiß sicher, was ich meine und hat eigene dafür. Die wachsende Prekarisierung einer ehemals (ausgeglichener) auskömmlichen Arbeitswelt ist IMO schon jetzt an jeder Ecke zu betrachten. Lange wurde diese mit dem Begriff der Einkommensschere (eher verharmlosend) umschrieben. Die Prekarisierung der Meinungswelt hat uns den Populismus beschert. Aber bleiben wir @topic:

"KI nimmt Inhalte weg":

Das sehen wir schon real an der Frequenz in diesem Forum - und jeder der KI nutzt, wird das bestätigen (oben sind ja vom Kollegen @CamelCase ja schon ein paar Grafiken zugereicht worden.

Die KI schadet sich - entgegen vielfältiger Auffassung/Hoffnung/Schwarzmalerei - IMO nicht selbst, obgleich sie das Inhaltswachstum des WWW 2.0 bereits jetzt ersichtlich reduziert. Denn: Die KI wächst ja trotzdem - durch die Interaktion mit ihren Usern. Die KI (besser gesagt: Der Konzern) bekommt also weiter den Input. Der Unterschied ist eben, dass nun der Konzern den Input hat - nicht mehr die Allgemeinheit. Das ist doppelt günstig, weil auf diese Weise das Oligopol oder gar Monopol beschleunigt wird, denn wer jetzt nicht dabei ist, wird nie eine Chance auf die selben Inhalte haben.

Wir geben also eine weitere "Open Source-Quelle" auf und begeben uns in die geistige Abhängigkeit von Großkonzernen. Und das auf eine nie dagewesene Weise. Wer sich heute noch etwas Sensitivität dafür gewahrt hat, sieht, wie abhängig die Welt von MS-Word ist, obgleich ganz viele diese Abhängigkeit nicht mögen und es Alternativen gibt. Einzig, aus dem Strudel rauszukommen ist ein Kraftakt, der weit über den Wechsel der Textsoftware hinaus geht. KI ist geeignet derartige Abhängigkeiten schneller und stärker zu erzeugen als je eine Technologie zuvor. Und diese Technologie wird sehr wahrscheinlich am Ende von einem oder wenigen Weltkonzernen dominiert sein.

Das das einigen Sorgen bereitet ist weit weniger verwunderlich als dass es einigen scheinbar keine Sorgen bereitet. Das Problem ist nicht die (Technik der) KI an sich. Das Problem ist, das sie in der Hand von wenigen Konzernen ist und Konzerne (meist) anders mit Menschen/Gesellschaften umgehen, als verteiltere Strukturen. Und wie wir ja hübsch in den USA sehen, besteht eine gewisse Machtaffinität, was die Sorgen nicht mindern dürfte.

Viele Grüße, commodity

Ok - wie du an sich selbst sagst - innovation bedeutet nunmal auch das teils Dinge verloren gehen. Auch das ist nicht ungewöhnlich und nix KI-Spezifisches. Allerdings ist eben deine Darstellungsweise m.E. auch sehr einseitig. Zum einen befindet sich "die" KI eben nicht irgendwo - da es nicht "die eine" gibt. Zum anderen geht natürlich hier zwar auch wissen verloren - andersrum entstehen aber auch wieder neue Möglichkeiten (z.B. via Google Lens kann ich sogar chinesische Texte gut genug lesen um den Sinn dahinter zu verstehen).

Und natürlich gibt es Veränderungen - genauso wie bei jeder neuen Technik. Bevor das Internet flächendeckend vorhanden war wurde halt Papier durch die Gegend geschickt, ggf. mal nen Fax wenns dringend war. Aber es hat eben kaum einer 5 Min nach Versand angerufen "hast du das schon gelesen"? Nur: Das ist doch eben nix ungewöhnliches - "googeln" hat sich eben mittlerweile als Wort für "im Internet suchen" durchaus verbreitet, ich vermute mal grad bei den Kiddys muss man schon suchen damit man jemand findet der ne Bücherrei von innen gesehen hat (und das ggf. sogar in der Freizeit).

Natürlich kannst du sicher auch bei Foren usw. sehen das Leute wegbleiben weils über KI schneller geht - daher ja wie mehrfach erwähnt die Frage ob sich denn ein Forum in dieser Form denn halten MUSS? Es muss eben auch nen gewissen Mehrwert geben. Aber auch das ist doch nix "KI"-spezifisches. Wenn ich mich heute in mein Auto setze erwarte ich eben auch kein Radio mehr mit drehknöpfen um den Sender zu suchen - und wenn heute ein Anbieter sowas noch verkaufen wollte würde das vermutlich auch bei den meisten im Regal liegen gelassen werden, es wird da eben auch nen modernes Radio erwartet. Es gibt eben eher wenig Bereiche wo es _keine_ Veränderungen gibt - und mit jeder Veränderung gehen eben für gewöhnlich auch Dinge verloren (im Beispiel des Radios hast du heute vermutlich eher wenig "Lang- und Mittelwelle", wenns da überhaupt noch ne Station gibt die da sendet)

Am Ende ist es aber doch ganz einfach: Wir können uns hinsetzen und ins Glas heulen das die KI kaputt macht - ändern werden wir das nunmal nicht. Dann also sehen wie man damit umgeht... Mich persönlich stört eben nur ein wenig das ich fast alle Argumente die man so hört schon zig mal gehört habe... Bei der Kassette das die Musikindustrie zerstört wird, bei Google das "Menschen zu blöd werden",... Dieselben Argumente kommen jetzt halt alle wieder - und irgendwie befürchte ich das dieselben Argumente auch in 5 Jahren wiederkommen werden - was auch immer dann die nächste Erweiterung ist....

Und natürlich gibt es Veränderungen - genauso wie bei jeder neuen Technik. Bevor das Internet flächendeckend vorhanden war wurde halt Papier durch die Gegend geschickt, ggf. mal nen Fax wenns dringend war. Aber es hat eben kaum einer 5 Min nach Versand angerufen "hast du das schon gelesen"? Nur: Das ist doch eben nix ungewöhnliches - "googeln" hat sich eben mittlerweile als Wort für "im Internet suchen" durchaus verbreitet, ich vermute mal grad bei den Kiddys muss man schon suchen damit man jemand findet der ne Bücherrei von innen gesehen hat (und das ggf. sogar in der Freizeit).

Natürlich kannst du sicher auch bei Foren usw. sehen das Leute wegbleiben weils über KI schneller geht - daher ja wie mehrfach erwähnt die Frage ob sich denn ein Forum in dieser Form denn halten MUSS? Es muss eben auch nen gewissen Mehrwert geben. Aber auch das ist doch nix "KI"-spezifisches. Wenn ich mich heute in mein Auto setze erwarte ich eben auch kein Radio mehr mit drehknöpfen um den Sender zu suchen - und wenn heute ein Anbieter sowas noch verkaufen wollte würde das vermutlich auch bei den meisten im Regal liegen gelassen werden, es wird da eben auch nen modernes Radio erwartet. Es gibt eben eher wenig Bereiche wo es _keine_ Veränderungen gibt - und mit jeder Veränderung gehen eben für gewöhnlich auch Dinge verloren (im Beispiel des Radios hast du heute vermutlich eher wenig "Lang- und Mittelwelle", wenns da überhaupt noch ne Station gibt die da sendet)

Am Ende ist es aber doch ganz einfach: Wir können uns hinsetzen und ins Glas heulen das die KI kaputt macht - ändern werden wir das nunmal nicht. Dann also sehen wie man damit umgeht... Mich persönlich stört eben nur ein wenig das ich fast alle Argumente die man so hört schon zig mal gehört habe... Bei der Kassette das die Musikindustrie zerstört wird, bei Google das "Menschen zu blöd werden",... Dieselben Argumente kommen jetzt halt alle wieder - und irgendwie befürchte ich das dieselben Argumente auch in 5 Jahren wiederkommen werden - was auch immer dann die nächste Erweiterung ist....

Ich denke, man sollte hier mal mit einigen Begrifflichkeiten arbeiten. Wenn man das hier durchliest, sieht man, dass mit KI sehr viel gemeint sein kann. Die meisten beziehen sich aber eigentlich nur auf LLMs oder Diffusion Models (Text-to-Picture etc.)

LLMs sind stand heute nix anderes als eine Suchmaschine die Text in der Suchanfrage versteht und die Suchergebnisse in einen lesbaren Text bringt. Vernünftige LLMs geben dabei dann auch die Quellen an. Gleiches kann man auch erreichen, wenn man mehrere Suchmaschinen betätigt und dann das Ergebnis selber in einen Text umschreibt.

Wie auch bei den Suchmaschinen gibt das falsche Treffer und auch vermeintlich richtige Ergebnisse. Ein Nachrecherchieren bleibt nicht aus. Nur weil es im Internet geschreiben wurde, ist es nicht automatisch richtig. Gilt für Suchmaschinene, Wikis, LLMs.

In meinen Augen besteht der Riesenvorteil bei LLMs darin, dass man sich ziemlich vage und umgangssprachlich ausdrücken kann, das LLM aber doch zu einem sehr hohen Prozentsatz genau das richtige rausfindet. Oft genug findet man hier im Forum ja auch Anfragen und dann mit einem Text, dass sie nicht richtig wussten, nach was sie genau suchen müssten.

Bei den Diffusion Models wirds aber schon spannender. Die werden ja als "kreativ" verkauft. Und ja, sie werden immer besser. Da sind wir momentan an dem Punkt angelangt, wo Fragen zu Inhaber- und Lizenzrechten laut werden. Das wird mit Sicherheit auch zu einem Großteil geklärt werden. Nur eben jetzt noch nicht. Man muss sich nur vor Augen halten, dass Verlage jetzt noch immer streiten, wie denn die Sache mit Newsseiten ist, die Nachrichten aus mehreren Quellen gebündelt angeben.

Ganz spannend sind die Sachen, bei denen Diffusions Models mit LLMs "gekoppelt" werden. So kann man bei einem Prompt ein Bild einfügen und man erhält Auskunft über den Inhalt des Bildes. Memes werden zum einen Übersetzt und zum anderen wird erklärt, worauf das Meme anspielt.

Und auch rein im LLM-Bereich sind die Skript-Ergebnisse zunehmend brauchbarer. Dabei wirds aber sehr deutlich, dass man das nur als Vorschlag sehen sollte. Im umgekehrten Fall, dem De-Bugging, sind die Erfolge gleich viel größer. Zumindest gefühlt. Da sind wir dann wieder bei der Arbeitserleichterung.

LLMs sind stand heute nix anderes als eine Suchmaschine die Text in der Suchanfrage versteht und die Suchergebnisse in einen lesbaren Text bringt. Vernünftige LLMs geben dabei dann auch die Quellen an. Gleiches kann man auch erreichen, wenn man mehrere Suchmaschinen betätigt und dann das Ergebnis selber in einen Text umschreibt.

Wie auch bei den Suchmaschinen gibt das falsche Treffer und auch vermeintlich richtige Ergebnisse. Ein Nachrecherchieren bleibt nicht aus. Nur weil es im Internet geschreiben wurde, ist es nicht automatisch richtig. Gilt für Suchmaschinene, Wikis, LLMs.

In meinen Augen besteht der Riesenvorteil bei LLMs darin, dass man sich ziemlich vage und umgangssprachlich ausdrücken kann, das LLM aber doch zu einem sehr hohen Prozentsatz genau das richtige rausfindet. Oft genug findet man hier im Forum ja auch Anfragen und dann mit einem Text, dass sie nicht richtig wussten, nach was sie genau suchen müssten.

Bei den Diffusion Models wirds aber schon spannender. Die werden ja als "kreativ" verkauft. Und ja, sie werden immer besser. Da sind wir momentan an dem Punkt angelangt, wo Fragen zu Inhaber- und Lizenzrechten laut werden. Das wird mit Sicherheit auch zu einem Großteil geklärt werden. Nur eben jetzt noch nicht. Man muss sich nur vor Augen halten, dass Verlage jetzt noch immer streiten, wie denn die Sache mit Newsseiten ist, die Nachrichten aus mehreren Quellen gebündelt angeben.

Ganz spannend sind die Sachen, bei denen Diffusions Models mit LLMs "gekoppelt" werden. So kann man bei einem Prompt ein Bild einfügen und man erhält Auskunft über den Inhalt des Bildes. Memes werden zum einen Übersetzt und zum anderen wird erklärt, worauf das Meme anspielt.

Und auch rein im LLM-Bereich sind die Skript-Ergebnisse zunehmend brauchbarer. Dabei wirds aber sehr deutlich, dass man das nur als Vorschlag sehen sollte. Im umgekehrten Fall, dem De-Bugging, sind die Erfolge gleich viel größer. Zumindest gefühlt. Da sind wir dann wieder bei der Arbeitserleichterung.

Zitat von @charlesrhoward:

Was mir fehlt: Eine Diskussion darüber, wie man KI sinnvoll integriert, ohne sie zur Krücke für Fachlich-Überforderte zu machen. Denn genau da scheint’s momentan oft hinzudriften.

Ohne all das gelesen zu haben, meine Erfahrung. KI Dienstleister stürmen die Firmen:Was mir fehlt: Eine Diskussion darüber, wie man KI sinnvoll integriert, ohne sie zur Krücke für Fachlich-Überforderte zu machen. Denn genau da scheint’s momentan oft hinzudriften.

"Ihr MÜSST euch JETZT auf KI vorbereiten, sonst verliert ihr den Anschluss!!eins!!elf!.

Viele Unternehmer sind quasi schon verrückt. Aber wenn ich diese dann frage, was genau soll bei dir denn von KI abgelöst/optimiert werden, dann kommt nix. Und von der Gegenseite ebensowenig, außer dem Anspruch, erstmal alle Unternehmensdaten und -prozesse ausleuchten zu wollen.

Dann sage ich einfach: Abwarten, Tee trinken, irgendwann kommt dein Softwarehersteller und pflanzt dir was mit KI ein, etwas vielleicht sogar sinnvolles, weshalb du aber die neue (teurere) Version kaufen musst, aber am Ende Zeit gespart wird. Da wo sowieso nur low performer sitzen, haben diese dann noch weniger Produktives zu tun.

So genannt auch der neue Button in Outlook, der E-Mails per Knopfdruck übersetzt. Wenn man etwas googelt, kommt man ggf. nun schneller ans Ziel. Alles andere ist irgendwie Panikmache, bei denen Unternehmer teils für Unbekanntes die Geldbörse aufmachen. Es gibt auch schwarze Schafe in der Herde.

Zitat von @charlesrhoward:

Ganz ehrlich: Ich glaube, wir reden uns die KI-Nutzung oft auch ein bisschen schön.

Ja, sie kann schneller und oft sogar sauberer Code liefern als so manche „Teamlösung“, die aus zusammengeklebten Stack-Overflow-Schnipseln besteht – keine Frage. Aber was sagt das eigentlich über den Zustand vieler Teams oder Prozesse aus? Wenn ein Prompt an ChatGPT mehr Qualität bringt als ein echter Kollege, dann läuft doch irgendwo gewaltig was schief.

Ich finde auch, dass das mit dem „Baggerfahrer ersetzt den Vorarbeiter“ nur bedingt passt. Ein Baggerfahrer weiß, wie man das Ding sicher bedient – ein Prompt-User, der nicht mal weiß, was ein Try-Catch ist, ballert sich im schlimmsten Fall halt ein kaputtes Skript in die Produktion.

Effizienz ersetzt eben kein Verständnis.

Zitat von @c.r.s.:

KI löst in erster Linie Delegierungsprobleme: Häufig ist klar, dass etwas geht und wie es geht. Diejenigen, denen das klar ist, haben aber derzeit nicht die Aufgabe, es selbst umzusetzen, weil das wirtschaftlich und zeitlich unmöglich ist.

Die Bearbeitung der Teilschritte in Team-Strukturen erfordert vorab schon einen großen Zeiteinsatz zur Abstimmung und zum Erreichen eines gemeinsamen Verständnisses. Zurück kommen Resultate unterschiedlicher Qualität: Fehlende Kommentare, fehlende Erläuterung/Dokumentation, hochfragile funktionale Minima ohne Fehler-/Ausnahmenbehandlung, Stückwerke aus Schnipseln von Stack Overflow und Co, gern auch Tabs und Leerzeichen gemischt, um keinen Zweifel am eigenen Arbeitseinsatz zu lassen.

Das kann KI in den verbreiteten Skript- und Programmiersprachen anhand isolierter Probleme schon besser. Es hat also keinen Zweck, sich dem zu verweigern, weil man zukünftig Arbeitsaufträge im eigenen Interesse entweder heruntergebrochen direkt an KI stellt oder - bei komplexeren Problemen - an Menschen, die KI bedienen können. Die Arbeiter mit Schaufeln und ihr Vorarbeiter werden durch Baggerfahrer ersetzt.

Eine Stärke von LLMs ist die Kombination von reichlich vorhandenem Faktenwissen. Alles, was anhand umfassender Dokumentation lösbar ist, wird für meine Zwecke verlässlich gelöst, z.B. PowerShell, Bash, Python, Cloud- und Netzwerk-CLIs. Auch verbreitete Logik- oder Effizienzkniffe in C/C++ werden gut integriert. Die "zweite Meinung" und die manchmal damit verbundene Überraschung sind dem Weg zu einer eleganten Lösung sehr hilfreich.

Bei Instruktionen für eher selten verwendete Tools werden Funktionen und Parameter erfunden. Dann ist auch nach Korrektur in der Regel kein Weiterkommen.

Über die Prompts muss man sich etwas Gedanken machen, um keine Suggestivfragen einzubauen und sich der eigentlichen Frage in Schritten zu nähern. Die Erwartung, ein Problem, für das ich KI verwende, durch eine einzelne Frage zu lösen, habe ich in der Regel nicht.

Datenschutz und Compliance sind keine KI-spezifischen Themen, sondern stellen sich genauso für Suchanfragen und Forenbeiträge. Unternehmen haben die Infrastruktur und Prozesse, das zu kontrollieren oder sie haben sie nicht. KI bietet nun zumindest die Chance, das, was bislang das Unternehmen über die genannten Kanäle verließ, intern zu halten.

Grüße

Richard

KI löst in erster Linie Delegierungsprobleme: Häufig ist klar, dass etwas geht und wie es geht. Diejenigen, denen das klar ist, haben aber derzeit nicht die Aufgabe, es selbst umzusetzen, weil das wirtschaftlich und zeitlich unmöglich ist.

Die Bearbeitung der Teilschritte in Team-Strukturen erfordert vorab schon einen großen Zeiteinsatz zur Abstimmung und zum Erreichen eines gemeinsamen Verständnisses. Zurück kommen Resultate unterschiedlicher Qualität: Fehlende Kommentare, fehlende Erläuterung/Dokumentation, hochfragile funktionale Minima ohne Fehler-/Ausnahmenbehandlung, Stückwerke aus Schnipseln von Stack Overflow und Co, gern auch Tabs und Leerzeichen gemischt, um keinen Zweifel am eigenen Arbeitseinsatz zu lassen.

Das kann KI in den verbreiteten Skript- und Programmiersprachen anhand isolierter Probleme schon besser. Es hat also keinen Zweck, sich dem zu verweigern, weil man zukünftig Arbeitsaufträge im eigenen Interesse entweder heruntergebrochen direkt an KI stellt oder - bei komplexeren Problemen - an Menschen, die KI bedienen können. Die Arbeiter mit Schaufeln und ihr Vorarbeiter werden durch Baggerfahrer ersetzt.

Eine Stärke von LLMs ist die Kombination von reichlich vorhandenem Faktenwissen. Alles, was anhand umfassender Dokumentation lösbar ist, wird für meine Zwecke verlässlich gelöst, z.B. PowerShell, Bash, Python, Cloud- und Netzwerk-CLIs. Auch verbreitete Logik- oder Effizienzkniffe in C/C++ werden gut integriert. Die "zweite Meinung" und die manchmal damit verbundene Überraschung sind dem Weg zu einer eleganten Lösung sehr hilfreich.